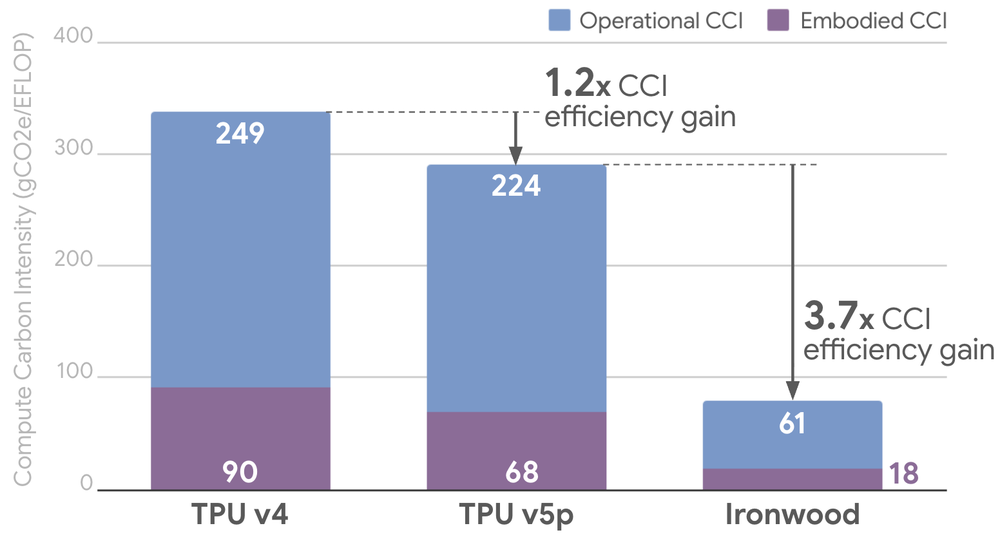

No ecossistema atual de tecnologia, a busca por escala em modelos de IA frequentemente esbarra em um desafio crítico: o custo operacional e o impacto ambiental. O Google anunciou recentemente o Ironwood, sua sétima geração de TPUs, focando em uma métrica que gestores de TI e equipes de engenharia precisam monitorar de perto: o Compute Carbon Intensity (CCI). A promessa é de um ganho de 3,7x na eficiência de carbono em comparação à geração anterior (TPU v5p).

Para empresas brasileiras que estão adotando estratégias de IA em larga escala, essa evolução não é apenas uma notícia de ESG; é um indicativo claro de como a densidade de processamento se traduzirá em redução de custo operacional (FinOps) e maior eficiência de hardware no longo prazo.

Entendendo a métrica essencial: Compute Carbon Intensity (CCI)

O mercado de cloud tem maturidade para ir além do uptime de SLA. O CCI — definido como o CO2 equivalente emitido por operação de ponto flutuante (CO2e/FLOP) — oferece uma visão holística que combina o CAPEX embasado nas emissões de fabricação (Scope 3) com o custo operacional de rodar workloads em data centers (Scope 1 e 2). Essa métrica permite que times de engenharia avaliem o retorno real sobre o carbono investido em cada modelo rodado.

A vantagem do Ironwood: Alta performance com pegada reduzida

O ganho de eficiência do Ironwood não surge por acaso; ele é fruto de uma performance de computação (utilizadas em FLOPs) que escala mais rápido do que o consumo de energia e as emissões de fabricação. Dados de janeiro de 2026 mostram que o hardware entrega uma performance 5x superior em comparação à geração anterior, tornando o custo de carbono por transação computacional drasticamente menor.

Figura 1: A evolução do CCI no ecossistema de TPUs do Google, refletindo otimizações em workloads de 2026.

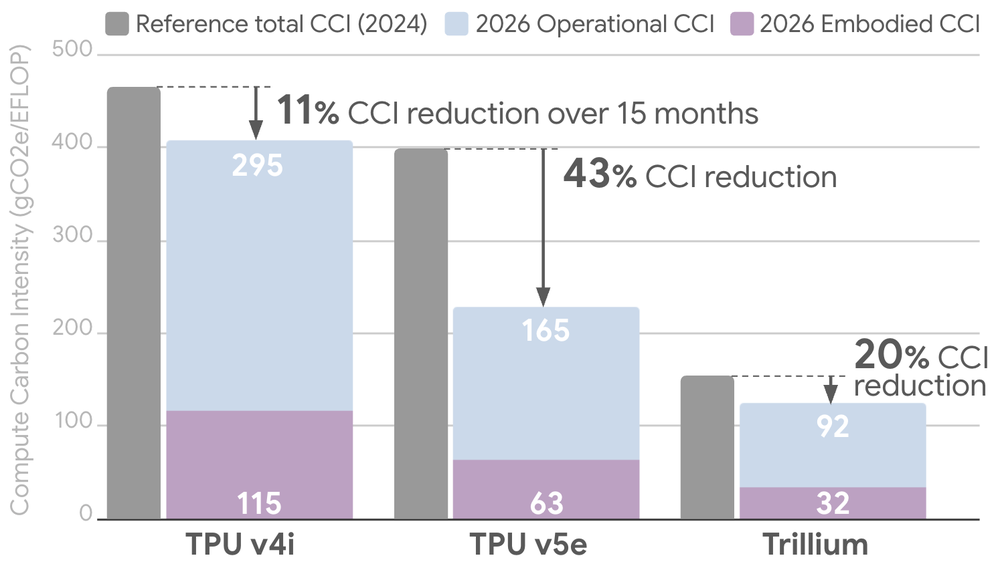

Otimizando a frota existente

Além do hardware, o software e o orquestrador de infraestrutura têm papel fundamental. O Google demonstrou que, entre 2024 e 2026, a eficiência do seu parque de TPUs existente (como v5e e Trillium) melhorou significativamente devido ao aumento na taxa de utilização bruta, provando que o scheduling inteligente e a orquestração são tão importantes quanto o hardware de ponta.

Figura 2: Ganhos na eficiência de deployment observados entre outubro de 2024 e janeiro de 2026.

Desacoplando o desempenho do custo energético

O que observamos aqui é uma lição prática de arquitetura para times de engenharia no Brasil que buscam sustentabilidade operacional:

- Software Efficiency (MoE): Adoção de arquiteturas Sparse (como Mixture of Experts) que direcionam computação apenas para os parâmetros necessários, reduzindo FLOPs ativos desnecessários.

- Precision Math (FP8): O uso de formatos de menor precisão, como FP8, dobrando o throughput e reduzindo pela metade a largura de banda de memória sem degradar a qualidade do modelo.

- Scheduling Inteligente: O balanceamento de carga contínuo para minimizar o consumo de potência ociosa e elevar o duty cycle.

Para o tomador de decisão, a conclusão é direta: a infraestrutura de IA está evoluindo para ser mais densa e eficiente. O sucesso na implementação de IA não se mede apenas pela acurácia do modelo, mas pela capacidade da sua infraestrutura — de pipeline a deployment — de escalar sem sacrificar o orçamento ou a eficiência energética.

Artigo originalmente publicado por David PattersonGoogle Distinguished Engineer, Google em Cloud Blog.