O Microsoft Agent Framework (MAF) atingiu recentemente a versão 1.0 GA, unificando as capacidades do AutoGen e do Semantic Kernel em uma plataforma madura, estável e pronta para ambientes de produção. Para equipes brasileiras de engenharia que buscam integrar sistemas multi-agente sem a complexidade operacional de orquestradores de containers complexos (como Kubernetes), este movimento simplifica drasticamente a arquitetura de aplicações baseadas em IA.

O que mudou no ecossistema de agentes

A versão 1.0 não é apenas um update de versão, mas uma consolidação estratégica da Microsoft sob o pacote Microsoft.Agents.AI. Para quem estava acompanhando os experimentos em preview, é essencial notar as quebras de contrato (breaking changes): a remoção de instruções dentro de ChatClientAgentOptions (agora migradas para o construtor do ChatClientAgent) e a renomeação do parâmetro thread para session em RunAsync são pontos cruciais para o refactoring do código legado. Além disso, a integração nativa com OpenTelemetry (UseOpenTelemetry()) agora é de primeira classe, facilitando drasticamente a observabilidade operacional — algo que já discutiremos em breve.

Por que o Azure App Service é o destino ideal?

Muitas empresas tendem a direcionar cargas de trabalho de LLM para clusters de Kubernetes precocemente. No entanto, o Azure App Service oferece, em muitos cenários, uma relação custo-benefício superior:

- Operacionalidade: Por ser um serviço gerenciado, a equipe pode focar no desenvolvimento do agente (em .NET ou Python) e não na manutenção de clusters.

- Background Processing via WebJobs: Agentes que consomem mais que o tempo de um ciclo HTTP (comuns em multi-agent systems) operam melhor em WebJobs, que compartilham configurações e Managed Identity com a API principal, eliminando o uso de senhas ou chaves em trânsito.

- Custos: Com instâncias P0v4, o custo-benefício para rodar API e worker no mesmo ambiente é significativamente mais previsível do que em infraestruturas distribuídas.

- Segurança: A utilização de Managed Identity para autenticação em serviços como Azure OpenAI, Service Bus e Cosmos DB remove o risco de exposição de segredos e simplifica o compliance.

Otimização e Escalabilidade: A visão estratégica

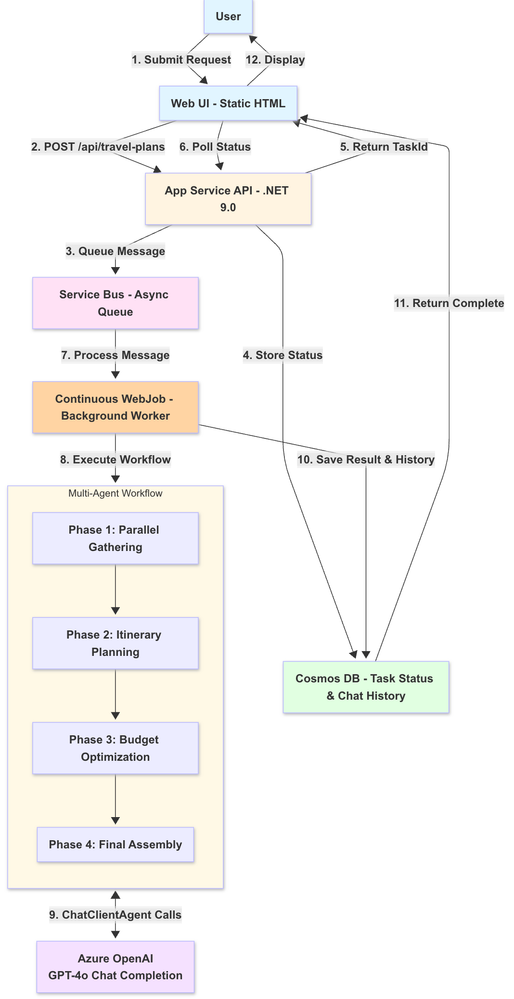

O uso do padrão Async Request-Reply é fundamental para garantir a estabilidade do sistema sob carga. Ao desacoplar o processamento através do Azure Service Bus e utilizar o Cosmos DB para persistência temporária de estados (usando TTL para minimizar custos de storage), a infraestrutura ganha resiliência. Em um cenário de falha, o worker pode retomar a tarefa ou ser reiniciado sem impactar a disponibilidade da interface do usuário.

Para times de engenharia no Brasil, a adoção desta stack permite um time-to-market acelerado, já que o uso do azd (Azure Developer CLI) provisiona toda a stack — incluindo os recursos de monitoramento Application Insights e Log Analytics — com um único comando, reduzindo o risco de discrepâncias entre ambientes durante o deploy.

Artigo originalmente publicado em Azure Updates - Latest from Azure Charts.