Migrar a infraestrutura de load balancing de um ambiente on-premises para o Google Cloud é um movimento comum para empresas brasileiras que buscam maior elasticidade e eficiência operacional. No entanto, o desafio central não é a conectividade, mas o que fazer com as regras de negócio acumuladas durante anos nos appliances legados.

Essas configurações geralmente carregam uma complexidade que, se migrada sem critério, pode se tornar uma dívida técnica permanente na nuvem. A boa notícia é que o Application Load Balancer do Google Cloud oferece ferramentas para modernizar o tráfego enquanto mantém o SLA necessário, permitindo uma migração consultiva e não apenas mecânica.

Uma abordagem faseada para a migração

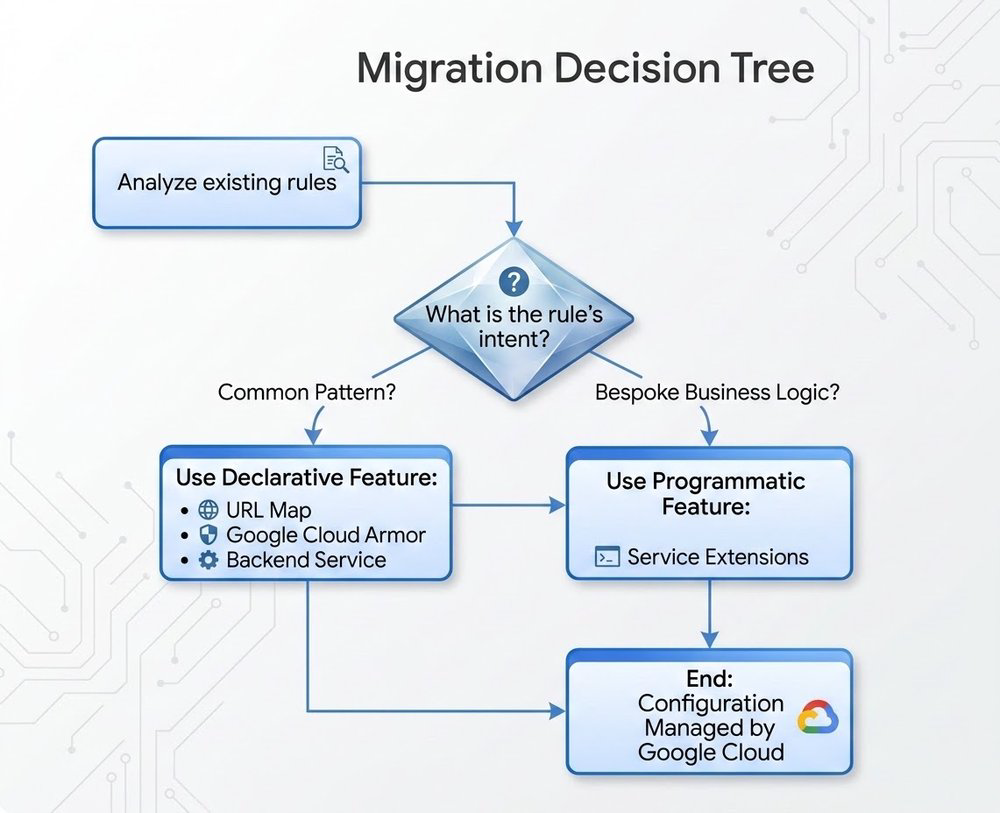

A migração de sistemas baseados em scripts imperativos para um modelo declarative-first exige um plano estruturado para evitar desperdícios e garantir estabilidade.

Fase 1: Discovery e mapeamento

O primeiro passo é o inventário real. É comum encontrar regras obsoletas que não agregam mais valor. Categorize as regras em:

- Padrões Comuns: Lógicas universais como redirects HTTP/HTTPS, header manipulation e ACLs básicas.

- Bespoke Business Logic: Lógicas proprietárias, como autenticação customizada ou manipulação de corpo de resposta, que demandam uma abordagem mais profunda.

Fase 2: Escolha o equivalente no Google Cloud

Não tente copiar a implementação anterior. O objetivo é utilizar os recursos nativos para reduzir o overhead de gestão.

Opção 1: O caminho declarativo (para 80% das regras)

Para a grande maioria dos casos de uso, utilize as capacidades nativas do Load Balancer. Isso simplifica o Version Control e o gerenciamento de state:

- Redirects/rewrites -> HTTP(S) Load Balancing URL maps

- ACLs/throttling -> Google Cloud Armor

- Session persistence -> Backend service configuration

Opção 2: O caminho programático (para regras complexas)

Quando o padrão não atende, o Service Extensions permite injetar código personalizado (em Rust, C++ ou Go) diretamente no data path, mantendo a performance com uma arquitetura moderna.

Fase 3: Testes e validação

Não subestime a necessidade de um ambiente de staging espelhado. Valide o comportamento das novas regras, especialmente onde a lógica proprietária (via Service Extensions) foi aplicada, garantindo que o throughput e a latency estejam alinhados às expectativas de negócio.

Fase 4: Cutover faseado (Canary Deployment)

A migração deve ser gradual. Utilize uma estratégia de canary, movendo pequenos incrementos de tráfego (5-10%) enquanto monitora métricas vitais. Tenha um plano de rollback claro, pronto para ser executado via GitOps caso a telemetria aponte anomalias.

Melhores práticas para uma migração fluida

- Analise antes, migre depois: O erro mais caro é migrar lógicas legadas que não possuem mais propósito.

- Priorize o declarativo: Sempre que possível, substitua scripts customizados pelos recursos nativos (Cloud Armor, URL Maps). A manutenção é menor e a integração é nativa.

- Use Service Extensions com parcimônia: Deixe o código customizado apenas para o que for estritamente necessário.

- Observability é o segredo: Monitore exaustivamente o tráfego tanto na fonte quanto no destino durante o período de transição.

- Capacite o time: A mudança de paradigma exige que a equipe de engenharia entenda profundamente os conceitos de Cloud Load Balancing para garantir a sustentabilidade da plataforma a longo prazo.

Migrar load balancers é muito mais do que mover caixas para a nuvem; é tratar a infraestrutura como código e garantir que a camada de borda da sua empresa esteja pronta para escalar conforme o seu crescimento.

Artigo originalmente publicado por Xiaozang Li, Customer Engineer, Google Cloud em Cloud Blog.