O desafio: A falha na distribuição de modelos de IA em escala

A distribuição de modelos de IA em ambientes de produção apresenta gargalos críticos de performance, eficiência operacional e custos. Considere um cenário comum: uma equipe de ML mantém um cluster Kubernetes com 200 nós de GPU. Ao realizar o deploy de uma nova versão de um modelo com 70B de parâmetros, como o DeepSeek-V3 (~130 GB), cada nó precisa de uma cópia local. Isso gera um tráfego de saída de 26 TB do seu bucket ou model hub, sobrecarregando a infraestrutura de origem e disparando custos de rede.

A escala atual dos repositórios de modelos expõe claramente essas limitações:

- O Hugging Face Hub hospeda mais de 1 milhão de modelos, com arquivos que frequentemente superam 10 GB (formatos como safetensors e GGUF).

- O ModelScope Hub suporta uma base global crescente, com modelos como Qwen e Yi exigindo alta largura de banda para sync.

Embora tais plataformas tenham democratizado o acesso, a distribuição desses artefatos via protocolos legados esbarra em problemas como:

- Git LFS: Otimizado para versionamento e não para fan-out em larga escala.

- Rate limits: Bloqueios em requisições intensivas.

- Custos de egress: A transferência repetida de dados idênticos encarece drasticamente a conta final.

Abordagens como NFS mounts ou mirrors apresentam riscos de inconsistência (modelos desatualizados) ou complexidade excessiva. A questão estratégica para engenheiros no Brasil — onde latência de rede em nuvens públicas frequentemente impacta o time-to-market — é: como escalar o download para que o 200º nó seja tão rápido quanto o primeiro? A resposta reside no suporte nativo aos protocolos hf:// e modelscope:// no Dragonfly.

O que é o Dragonfly?

O Dragonfly é um projeto graduado da CNCF voltado para a distribuição de arquivos baseada em P2P (Peer-to-Peer). Originalmente desenhado para a escala do Alibaba (bilhões de requisições diárias), o projeto transforma cada nó que realiza o download em um seeder para seus pares.

Arquitetura base:

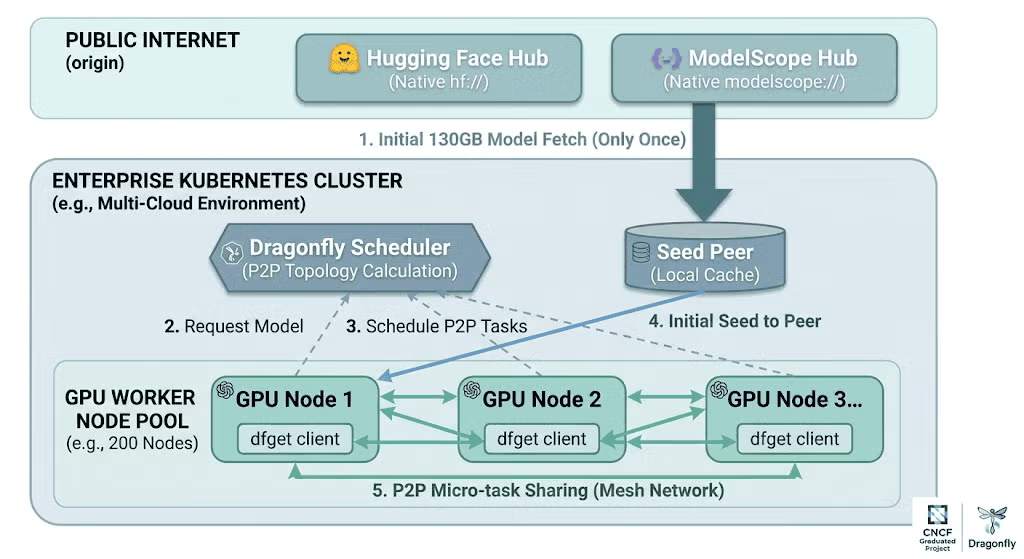

Figura 1: Fluxo de ponta a ponta da distribuição P2P no Dragonfly. O Seed Peer busca o modelo na origem apenas uma vez (Passo 1), o Scheduler calcula a topologia P2P (Passo 3) e os nós de GPU compartilham os pedaços (Passo 5) — reduzindo o tráfego de origem de 26 TB para cerca de 130 GB em um cluster de 200 nós.

A eficiência aqui é notável: o Dragonfly divide arquivos em pedaços pequenos (chunks), permitindo que cada nó compartilhe partes do modelo assim que as recebe, antes mesmo da conclusão do download completo. Isso não apenas reduz o tráfego para o hub em 99,5%, mas minimiza a latência efetiva para todo o cluster.

O protocolo hf:// e modelscope://

Com a integração desses backends nativos, o dfget (CLI do Dragonfly) entende agora as URLs do Hugging Face e ModelScope diretamente. Sem necessidade de proxies complexos ou wrappers de shell que escondem a autenticação.

Exemplos de uso práticos para o seu time de engenharia:

# Download de um repositório inteiro com aceleração P2P

dfget hf://deepseek-ai/DeepSeek-R1 -O /models/DeepSeek-R1/ -r

# Acesso a repositórios privados com token

dfget hf://owner/private-model/weights.bin \

-O /models/private/weights.bin \

--hf-token=token_secreto

Impacto real para empresas brasileiras

Para times de plataforma que gerenciam infraestrutura crítica, a adoção do Dragonfly traz ganhos imediatos:

- Multi-hub unificado: Se você utiliza Llama (Hugging Face) e Qwen (ModelScope), o Dragonfly provê uma camada de cache e distribuição comum, unificando o controle de tráfego.

- CI/CD resiliente: Ao pin-ar versões, você garante que pipelines de ML não falhem por flakiness de download do hub, utilizando a cache P2P local.

- Ambientes segregados (Air-gapped): Em setores regulados, você pode realizar o seed via uma área de staging e deixar que a malha P2P distribua o modelo internamente sem necessidade de saída à internet.

Comparado ao uso de CLIs nativas, o Dragonfly vence pela integração Kubernetes-native (via DaemonSet) e pela capacidade de orquestração do tráfego interno do cluster.

Próximos passos e Conclusão

A arquitetura do Dragonfly é extensível. A capacidade de tratar modelos de IA como artefatos de infraestrutura é o que separa empresas que apenas rodam IA daquelas que escalam IA de forma inteligente. Implementar essa camada de abstração reduz a dependência da disponibilidade dos serviços externos e oferece previsibilidade de custos — um pilar essencial para qualquer estratégia bem-sucedida de FinOps em projetos de IA.

Artigo originalmente publicado por Pavan Madduri, CNCF Kubestronaut em Cloud Native Computing Foundation.