A integração entre o Azure Logic Apps e sistemas SAP frequentemente começa de forma simples, mas o verdadeiro desafio surge na garantia da qualidade dos dados. Em fluxos críticos de negócio, a validação não é apenas uma boa prática: ela é o que define a integridade do processo. Quando dados inválidos permeiam o pipeline, os custos operacionais aumentam rapidamente devido a documentos gerados incorretamente ou à necessidade de processos manuais de correção. Em cenários transacionais, uma falha pode forçar estratégias complexas de rollback ou compensação que times de engenharia preferem evitar.

Esta série de dois artigos propõe um padrão de implementação prático para o uso do conector built-in do SAP com o Azure Logic Apps de forma estruturada. Na parte 1, exploramos a mecânica da integração, o fluxo de dados e, fundamentalmente, como tratar e propagar erros de forma que eles sejam visíveis e gerenciáveis.

1. Introdução

Cenário:

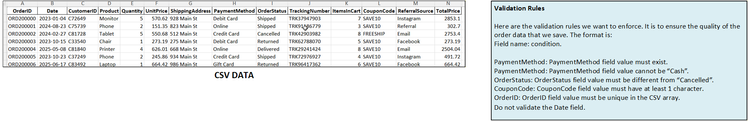

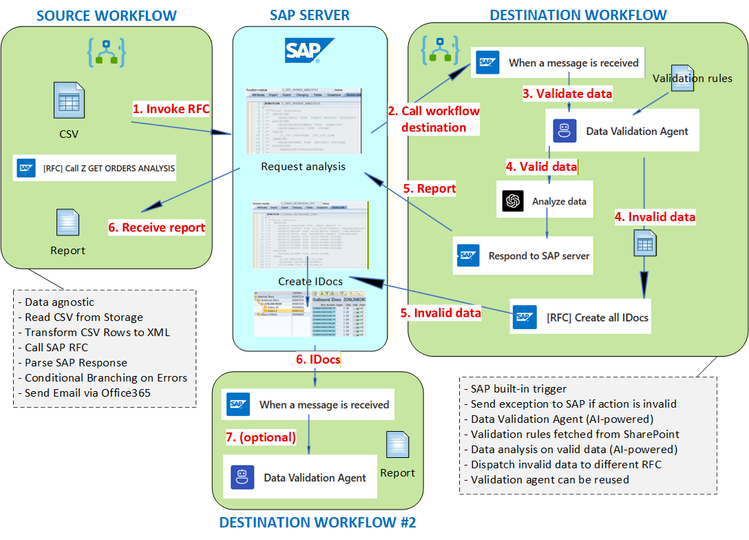

O fluxo consiste em um Logic App que envia arquivos CSV para um sistema SAP, onde a carga é encaminhada para um segundo workflow responsável por:

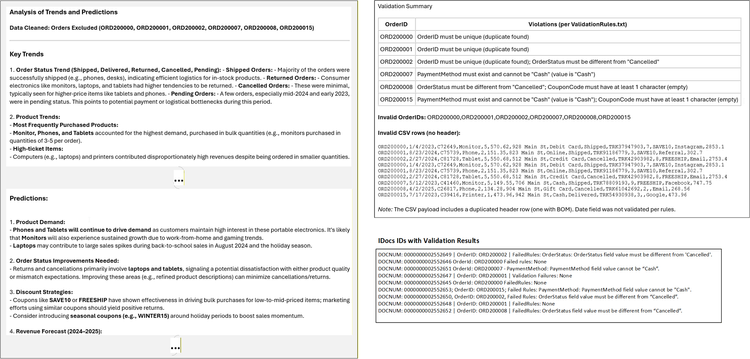

- Validação baseada em regras: garantindo que apenas dados íntegros sigam para o processamento.

- Análise/Enrichment: utilizando capacidades de IA (que abordaremos na parte 2).

O workflow retorna resultados validados ou erros de forma consistente, com notificação via e-mail. Este padrão é agnóstico ao domínio e pode ser aplicado a pedidos, inventário ou feeds de dados mestres, substituindo legados corporativos como o Microsoft BizTalk.

Implementação Geral e Pontos de Atenção

O desenho da solução separa as responsabilidades entre o workflow de ingestão e o workflow de processamento (destination). A comunicação utiliza SAP RFCs (Remote Function Calls). O uso de IA para geração de código (XPath, JavaScript, expressões Logic Apps) acelera o scaffolding, mas exige validação rigorosa em ambiente de runtime para garantir a correta propagação das exceções.

Considerações sobre o Contrato (SAP ↔ Logic Apps)

A estabilidade desta integração reside num contrato bem definido: o envio de dados via IT_CSV (table-of-lines) e o recebimento de respostas estruturadas via EXCEPTIONMSG e RETURN (BAPIRET2). Isso permite que o workflow de processamento evolua sem afetar o SAP, desde que a interface de comunicação permaneça inalterada.

Conclusão

O sucesso de uma integração enterprise entre Azure e SAP depende menos da conectividade inicial e mais da governança sobre os erros. Ao tratar falhas como resultados de primeira classe no SAP, reduzimos o tempo de troubleshooting e evitamos o acúmulo de processamentos parciais (zombie states). Na segunda parte desta análise, focaremos na camada de agentes (IA) e como instrumentar a validação inteligente sobre esses dados validados.

Artigo originalmente publicado por Emmanuel Abram Profeta em Azure Updates - Latest from Azure Charts.