A Microsoft anunciou recentemente uma atualização significativa para a Azure AI Foundry: o suporte ao padrão WebRTC (Web Real-Time Communication) na Voice Live API. Para empresas brasileiras que estão escalando agentes de IA baseados em voz, essa mudança não é apenas incremental — ela ataca um dos gargalos críticos do setor: o latency.

Tradicionalmente, a implementação de interfaces de voz em navegadores ou aplicações móveis dependia quase exclusivamente de WebSockets. Embora eficazes, WebSockets tratam áudio como fluxos de dados genéricos, exigindo que os desenvolvedores criem custom buffering e lógica complexa de sincronização. O WebRTC altera essa dinâmica por ser nativamente otimizado para mídia em tempo real.

Por que o WebRTC é um divisor de águas para agentes de voz?

A adoção de WebRTC em vez de uma abordagem puramente via WebSocket traz três benefícios operacionais imediatos para as equipes de SRE e de engenharia:

- Redução drástica de latency: O WebRTC minimiza o atraso no processamento do sinal, um fator determinante para que a experiência de conversação não pareça robótica ou desconectada durante interações críticas (ex: suporte ao cliente).

- Manipulação de mídia nativa: Com suporte embutido para codecs de áudio e vídeo, a sobrecarga de processamento para codificação e decodificação na ponta (o cliente) é reduzida, otimizando o throughput.

- Resiliência de rede: O protocolo é projetado para lidar com packet loss e jitter de forma inteligente, elementos essenciais em um ambiente como o Brasil, onde a conectividade de rede pode oscilar significativamente em dispositivos móveis.

Implementação prática e fluxo de trabalho

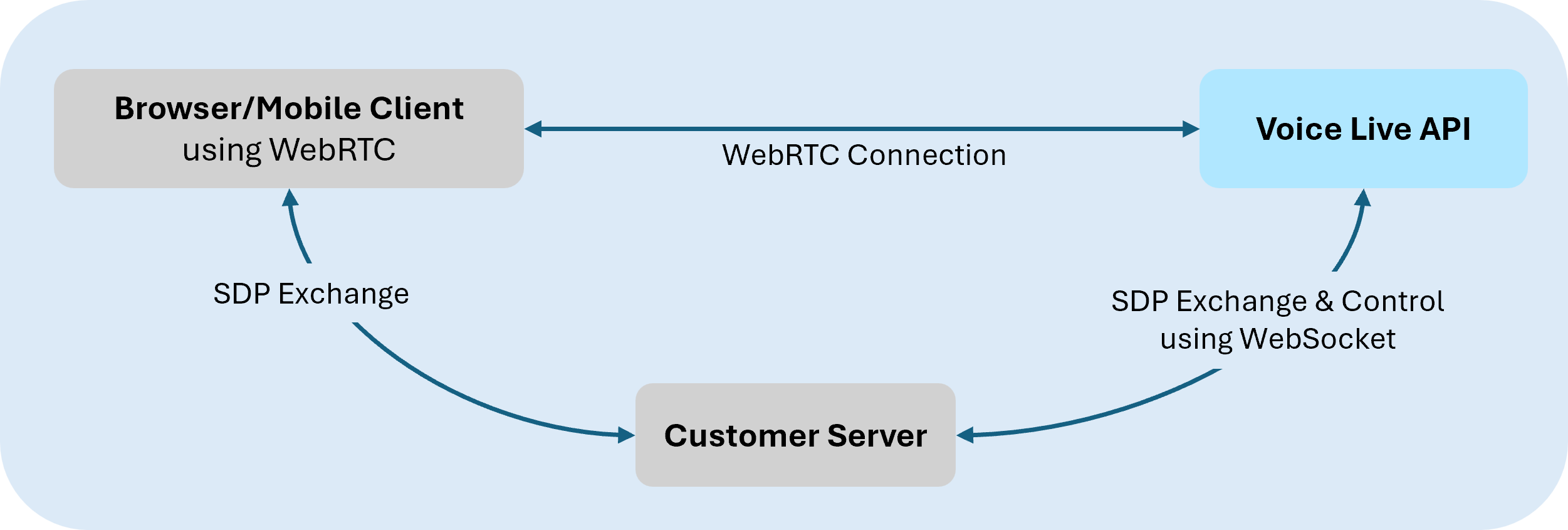

O novo fluxo técnico requer a substituição da endpoint padrão pela nova voice-live/realtime/calls. A arquitetura agora mantém um canal de controle via WebSocket para a troca de mensagens de negociação SDP (Session Description Protocol). Uma vez estabelecida a conexão via WebRTC, o tráfego de mídia é transmitido via RTP media tracks.

É importante notar que os eventos de controle (como o ciclo de vida da resposta e a detecção de fala) continuam sendo tratados pelos Data Channels do WebRTC ou pelo canal de controle WebSocket original. Para os tomadores de decisão, isso significa que, embora haja uma curva de aprendizado para a equipe de desenvolvimento (devido à complexidade inerente da negociação de conexões P2P/WebRTC), os ganhos em user experience e em eficiência operacional de longo prazo superam o esforço de migração.

Empresas que dependem de voz como canal principal de interação devem monitorar suas métricas de observability para garantir que a transição para este preview seja estável e não comprometa os SLAs existentes durante a fase de testes.

Artigo originalmente publicado em Azure Updates - Latest from Azure Charts.