A adoção massiva de ferramentas de Inteligência Artificial generativa trouxe um dilema crítico para as empresas brasileiras: como equilibrar a aceleração da produtividade com o aumento exponencial dos riscos de vazamento de dados. A IA não cria riscos inéditos, mas magnifica vulnerabilidades preexistentes, como o compartilhamento inadequado de documentos e o acesso excessivo (over-permissioning), transformando o que antes era um incidente isolado em um problema de escala sistêmica.

Por que a IA mudou a dinâmica da segurança de dados

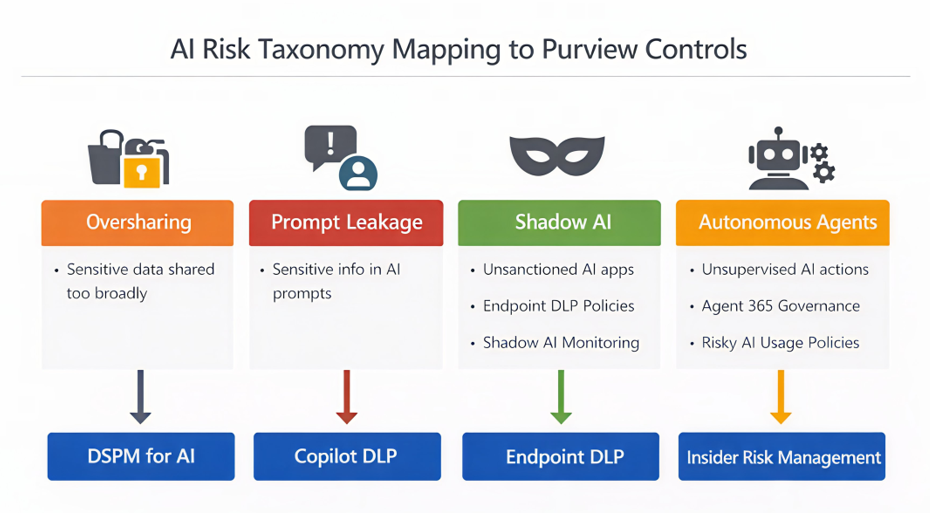

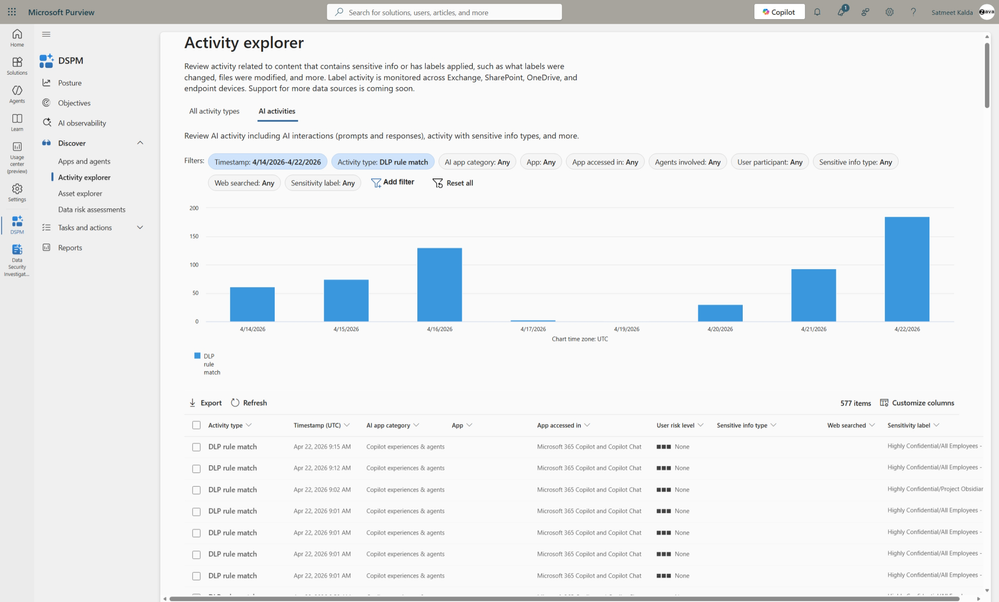

O principal diferencial de risco na era da IA está na velocidade e na autonomia. Dados confidenciais, segredos industriais ou informações sensíveis de clientes, que antes descansavam em pastas de acesso restrito no SharePoint, agora podem ser indexados e sumarizados pelo Microsoft Copilot a partir de um prompt casual. Além disso, enfrentamos o fenômeno do Shadow AI, onde colaboradores utilizam ferramentas não sancionadas para processar dados proprietários, e a ascensão de agentes autônomos, que operam sem intervenção humana, aumentando as superfícies de ataque para exfiltration e acesso não autorizado.

O papel do Microsoft Purview e DSPM

O Data Security Posture Management (DSPM) no Microsoft Purview é a resposta estratégica para essa complexidade. Ele consolida as capacidades de Data Loss Prevention (DLP), Insider Risk Management e Information Protection em uma visão unificada. A grande mudança aqui é a capacidade de estender essa governança não apenas para o ecossistema Microsoft (M365, Azure, Fabric), mas também para plataformas externas como Google Cloud Platform, Snowflake e Databricks.

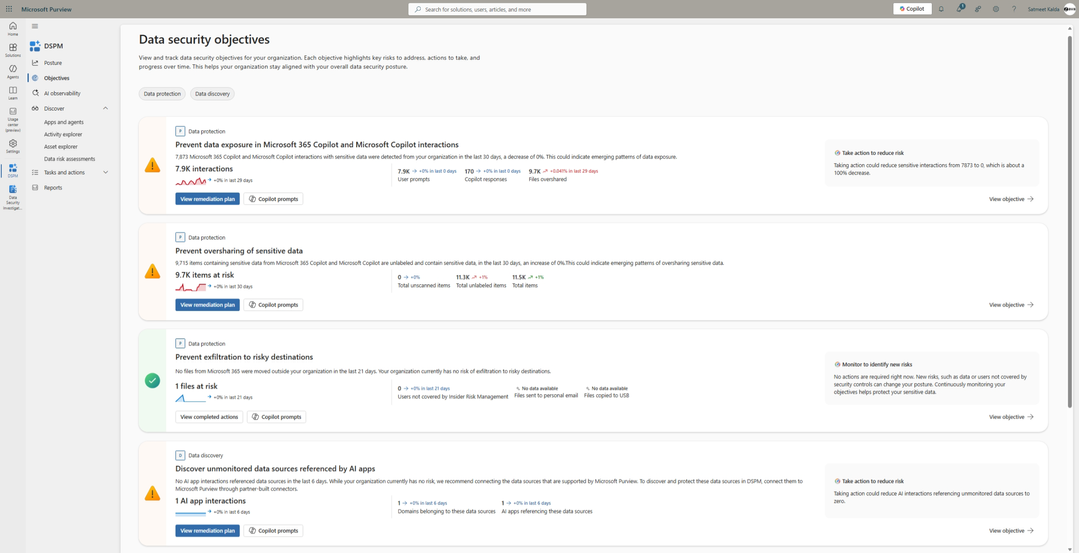

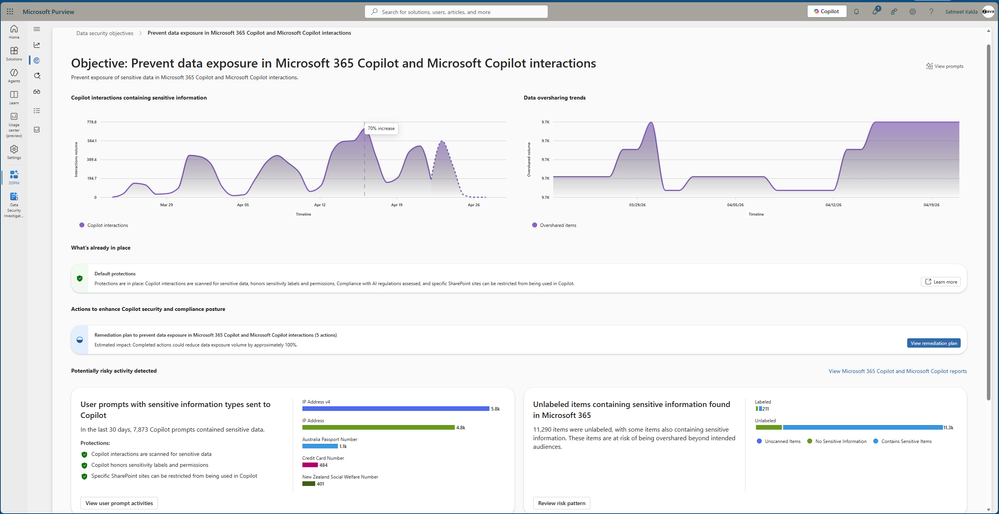

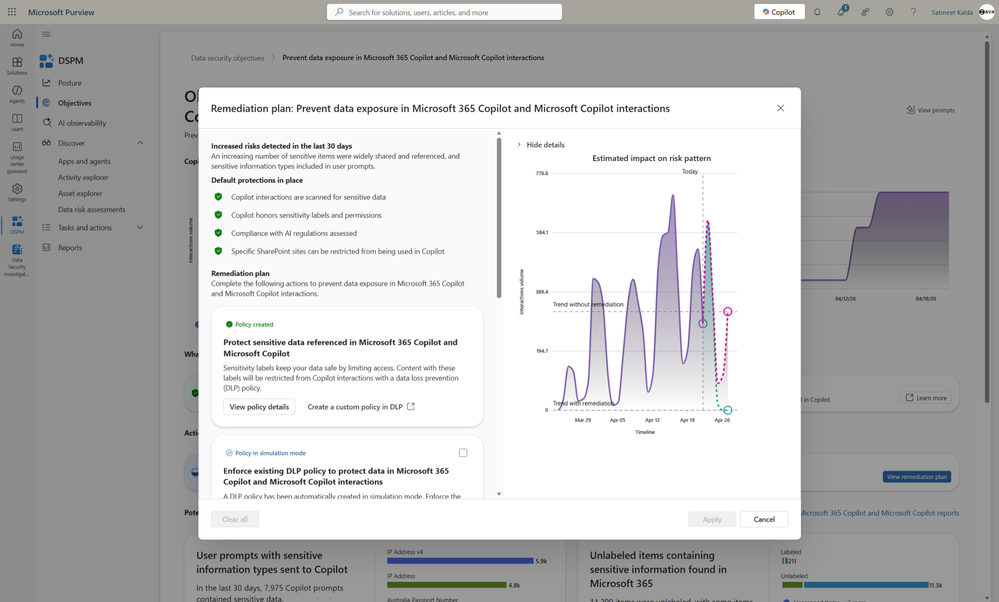

A transição de uma visão puramente reativa para uma postura proativa é facilitada pelos novos "objetivos de segurança aos dados". Em vez de configurar componentes de forma isolada, as equipes de TI e segurança podem selecionar um objetivo específico e seguir workflows guiados, que priorizam ações baseadas na maturidade e criticidade do ambiente.

Pilares Práticos de Implementação

-

Proteção de prompts no Copilot: O primeiro passo prático é configurar políticas de DLP para que o Copilot detecte e bloqueie prompts que contenham informações sensíveis (como números de cartões de crédito ou CPF). O uso de simulation mode é vital aqui: ele permite que a engenharia avalie o impacto antes de implementar o bloqueio total, evitando interrupções indevidas na operação.

-

Visibilidade sobre Shadow AI: Antes de qualquer regra de bloqueio, é preciso mapear o uso. Aproveite os dashboards de Apps and Agents do Purview para identificar quais ferramentas de IA estão sendo mais acessadas pelos times e quais volumes de dados estão sendo expostos. A visibilidade é o pré-requisito para uma estratégia baseada em fatos.

-

Operacionalização dos objetivos (Data Security Objectives): O sucesso depende de uma governança coesa. Utilize os workflows do Purview para alinhar os times de segurança, compliance e jurídico. Ao invés de tratar a segurança como um gasto, aborde-a como um viabilizador para a adoção segura de IA.

Transformando o Ciclo de Risco em Governança

O modelo operacional de sucesso segue quatro etapas: Discover (identificação contínua), Remediate (ações automatizadas como revogação de acessos), Prevent (criação de políticas de DLP e labels de classificação) e Monitor (ajuste fino baseado em alertas e métricas de desfecho).

Conclusão e Próximos Passos

Para empresas brasileiras, a maturidade na governança de IA não se mede pela quantidade de ferramentas ativadas, mas pela capacidade de demonstrar progresso mensurável na postura de segurança. Inicie com quick wins: ative o monitoramento, identifique o Shadow AI e, gradualmente, mova suas políticas de simulation para enforcement. Essa abordagem faseada reduz conflitos internos e garante que a inovação via IA não ultrapasse as barreiras de segurança necessárias para o crescimento sustentável da organização.

Artigo originalmente publicado em Azure Updates - Latest from Azure Charts.