TL;DR

Este artigo detalha as recentes otimizações no pipeline de build do Azure App Service para aplicações Python, com foco em cargas de trabalho de IA com muitas dependências. Através da substituição do gzip por Zstandard, a adoção do gerenciador de pacotes uv e a otimização de sincronização de arquivos, a plataforma obteve uma redução de até 79% no tempo total de build, garantindo maior estabilidade e eficiência operacional para desenvolvedores e arquitetos que operam aplicações em escala.

Panorama do Azure App Service

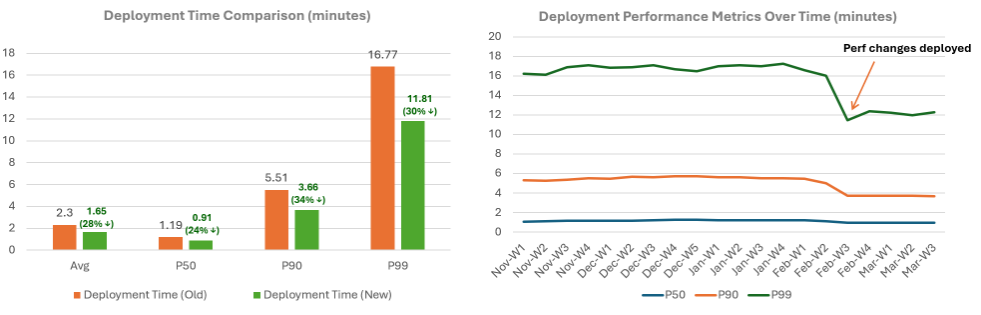

O Azure App Service (Linux) funciona como uma plataforma PaaS robusta para diversas linguagens, incluindo Python, .NET e Node.js. Como o fluxo de deploy influencia diretamente a experiência do desenvolvedor e o time-to-market, a otimização desse pipeline é um esforço contínuo da Microsoft. Recentemente, focou-se em reduzir latências na infraestrutura de build, resultando em uma melhoria média de 30% na velocidade de deployment para aplicações Python em toda a frota, com ganhos mais expressivos em aplicações complexas de IA.

Onde ocorria a perda de performance?

As aplicações Python no Azure App Service utilizam o Oryx para builds remotos. Telemetria interna revelou que 70% dos deploys dependem de arquivos requirements.txt via pip install. Em testes com uma aplicação de 7.5 GB com PyTorch, o gargalo foi mapeado nos seguintes estágios do Kudu:

- Extração: Código-fonte.

- Preparação: Ambiente virtual Python.

- Instalação de dependências: 34% do tempo de build.

- Cópia de arquivos: 8% do tempo.

- Compressão: 58% do tempo via tar + gzip.

- Persistência: Escrita em storage SMB (

/home).

Por que o uso de arquivos compactados?

O diretório /home opera sobre um SMB mount, onde operações de I/O de milhares de arquivos pequenos são proibitivas. A compressão em um único arquivo é a solução técnica para otimizar o tempo de cold start, mesmo que a fase de compressão seja o maior gargalo no build.

O que foi alterado para otimizar o pipeline?

Compressão com Zstandard (zstd)

Substituímos o gzip single-threaded por zstd, que lida melhor com compressão paralela. Os resultados foram impressionantes, com uma redução no tempo de compressão de 7.53 min para 1.18 min (6.4x mais rápido).

Instalação de pacotes via uv

Introduzimos o uv (escrito em Rust) para processar o requirements.txt. Ele oferece performance superior de paralisação sem quebrar a compatibilidade (com fallback automático para pip). O tempo de instalação caiu de 4.35 min para 1.50 min (3x mais rápido).

Redução de File Copy e Cache de Wheels

Eliminamos cópias intermediárias desnecessárias, realizando o tar diretamente do diretório de build. Também implementamos um cache de read-only wheels para pacotes comuns, reduzindo acessos externos ao PyPI.

Resultados Combinados

Em benchmarks, a redução total do tempo de build em aplicações com dependências pesadas atingiu 79%. Em ambiente de produção, a latência média de deploy caiu 30%.

Confiabilidade e Runtime

Além do build, a resiliência foi melhorada via health-checks no Kudu e warm-up de workers, reduzindo em 30% erros de rede (502, 503, 499). Também ajustamos o Gunicorn para escalar conforme a fórmula (2 × NUM_CORES) + 1, extraindo performance real de SKUs multi-core.

Perguntas Frequentes

-

Por que a compressão Zstandard (zstd) foi escolhida para substituir o gzip?

O zstd foi adotado por ser multithreaded, reduzindo drasticamente o gargalo de compressão (de 58% do tempo de build para cerca de 1 min). Além disso, oferece melhor taxa de compactação que outras opções e possui suporte nativo no tar, simplificando o pipeline sem necessidade de dependências extras. -

Como o gerenciador de pacotes uv impacta o tempo de build?

O uv, escrito em Rust, substitui o pip tradicional para instalações em arquivos requirements.txt, otimizando o paralelismo no download e na resolução das dependências. Em experimentos, essa mudança reduziu o tempo de instalação de pacotes em até 3x, mantendo a compatibilidade com fluxos existentes via fallback automático. -

Como as novas estratégias de cache e warm-up afetam a confiabilidade?

A plataforma agora realiza o 'warm-up' do Kudu e mantém a afinidade com o worker, permitindo o reaproveitamento de caches locais de wheels. Isso evita re-downloads desnecessários em builds sequenciais e reduz falhas de cold-start (erros 502/503), aumentando a previsibilidade do deploys.

Artigo originalmente publicado em Azure Updates - Latest from Azure Charts.