Backend developers e arquitetos de sistemas que lidam com alta carga e baixa latência têm no Valkey um pilar fundamental para estratégias de caching e mensageria. Com o anúncio da general availability (GA) do Valkey 9.0 no Google Cloud Memorystore, entramos em uma nova fase onde eficiência de hardware e produtividade de desenvolvimento se encontram para reduzir a carga operacional em ambientes críticos.

Durante o período de preview, grandes players globais validaram a robustez da versão. O impacto é claro: melhorias arquiteturais, como a otimização de SIMD e prefetching de memória, não são apenas métricas de marketing — elas se traduzem em custos de infraestrutura reduzidos e maior capacidade de processamento.

Para empresas brasileiras no setor financeiro ou de e-commerce, onde o tráfego é altamente volátil, a estabilidade oferecida por uma plataforma gerenciada que entrega performance superior é vital. A transição para o Valkey 9.0 permite que times de engenharia foquem menos em ajustar parâmetros de baixo nível e mais em escalar as capacidades da aplicação.

Desempenho em Escala: Otimizações de Backend

A engenharia por trás do Valkey 9.0 foca em extrair o máximo das VMs multi-core. As melhorias de throughput e redução de latência são impulsionadas por três pilares críticos:

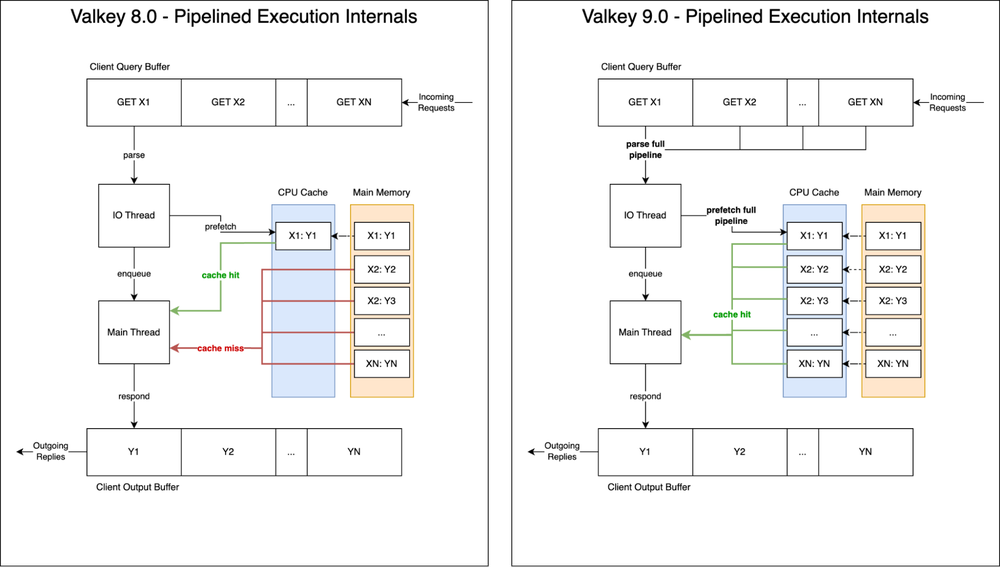

- Pipeline memory prefetching: Aumenta o throughput em até 40% ao otimizar o acesso à memória durante operações encadeadas.

- Zero copy responses: Reduz a necessidade de cópias internas na memória, entregando até 20% de ganho em throughput para grandes requisições.

- SIMD optimizations: Com otimizações específicas para operações de

BITCOUNTeHyperLogLog, é possível alcançar até 200% de incremento em performance para tarefas de contagem e análise.

A mecânica central aqui é o uso inteligente dos CPU caches. Ao prefetchar operações dentro de um pipeline, o Valkey 9.0 minimiza os cache misses, garantindo que a CPU trabalhe com os dados antes mesmo de serem solicitados, algo que reflete diretamente no SLA das suas aplicações mais exigentes.

Funcionalidades para o Desenvolvedor Moderno

Além da performance bruta, o Valkey 9.0 traz facilidades que antes exigiriam workarounds complexos em Lua script:

- Expiração granular (HEXPIRE): Agora é possível definir TTLs para campos individuais dentro de um hash. Isso simplifica drasticamente a gestão de sessões de usuário e objetos temporários, otimizando o uso do

keyspace. - Geospatial via Polygon: Essencial para aplicações de logística ou delivery, permitindo consultas geográficas complexas usando polígonos em vez de simples raios de busca.

- DELIFEQ (Conditional Delete): Uma mudança de paradigma para distributed locking. Agora é possível garantir que um lock só seja removido pelo processo que o adquiriu, sem o risco de corrupção de estado ou necessidade de lógica extra na aplicação.

Visibilidade e Operação Estratégica

Para times de plataforma e SREs, a nova capacidade de filtragem no CLIENT LIST é um divisor de águas. Poder isolar troubleshooting por versão de biblioteca, IP ou flags de conexão acelera o MTTR (Mean Time To Recovery) significativamente. Adicionalmente, o suporte a até 100 databases em modo cluster facilita adoções de estratégias como blue-green caching e isolamento lógico de ambientes em uma única instância gerenciada.

Considerando o roadmap do ecossistema, a adoção do Valkey 9.0 no Memorystore apresenta um caminho claro para modernização com risco reduzido. A capacidade de realizar upgrades in-place sem downtime remove uma das maiores barreiras para a adoção de novas tecnologias em ambientes de produção. Para empresas brasileiras que dependem de alta disponibilidade para crescer, este movimento do Google Cloud torna o cache in-memory uma peça central ainda mais eficiente e, fundamentalmente, aberta.

Artigo originalmente publicado por Jacob MurphySoftware Engineer em Cloud Blog.