Otimização Avançada de Prompts no Amazon Bedrock: O que muda na prática?

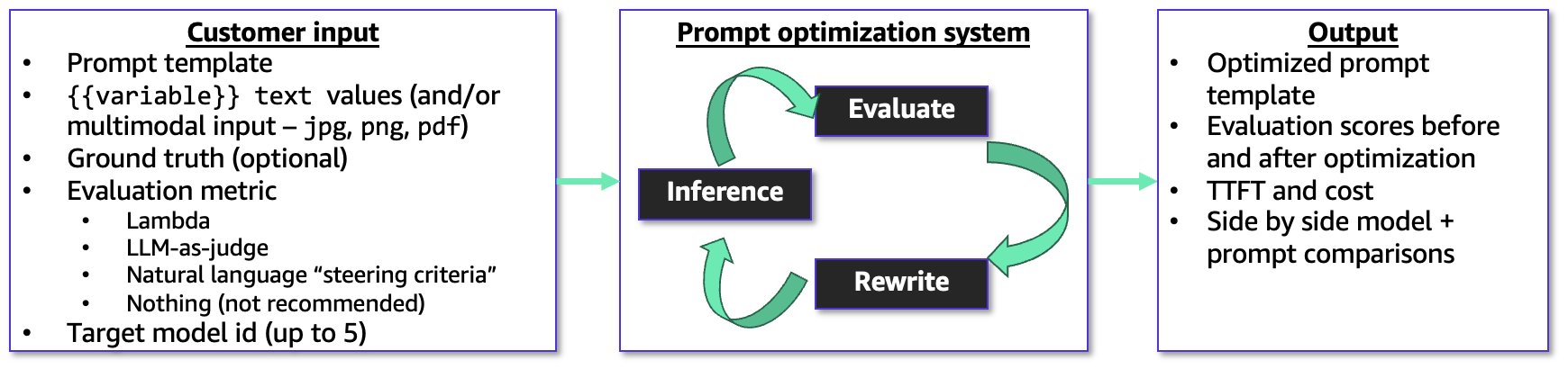

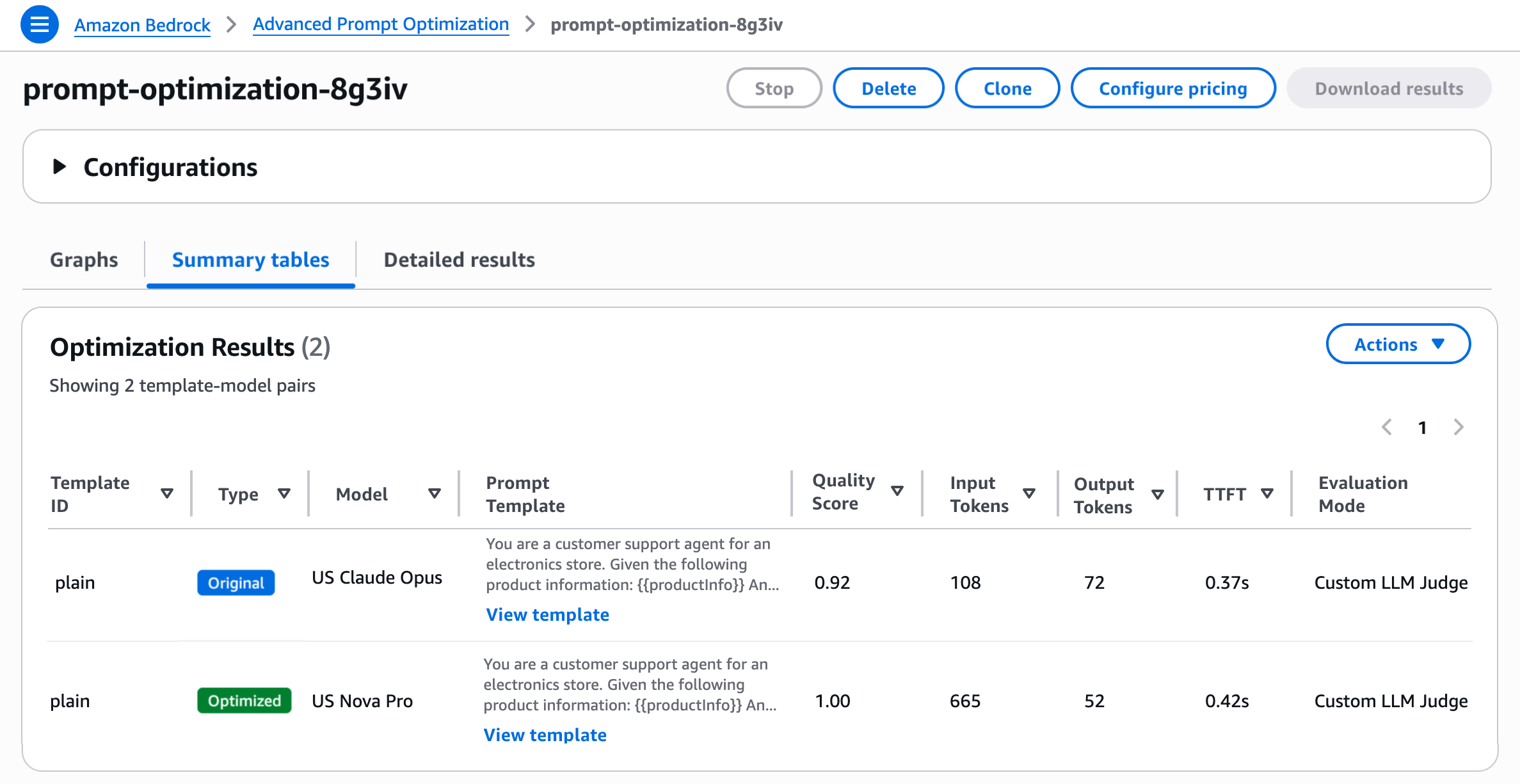

A nova ferramenta de Otimização Avançada de Prompts do Amazon Bedrock automatiza o refinamento de prompts através de um ciclo de feedback métrico. Ela permite comparar resultados em até cinco modelos simultaneamente, facilitando migrações e melhorias de performance. Ao utilizar funções Lambda, LLM-as-a-Judge ou critérios de direcionamento, engenheiros podem ajustar prompts com base em dados reais e ground truth, garantindo menor latência e maior precisão, mantendo a previsibilidade em ambientes de produção complexos.

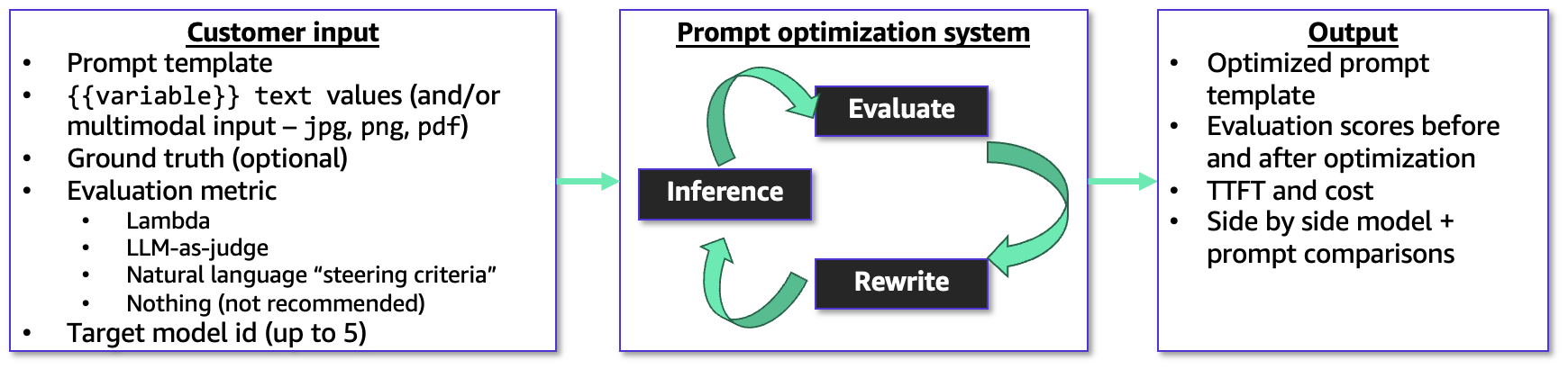

Historicamente, a otimização de prompts foi uma tarefa amplamente manual, quase artesanal. Com o lançamento do Amazon Bedrock Advanced Prompt Optimization, a AWS move esse fluxo para um cenário de LLMOps estruturado. Em vez de tentativa e erro manual, agora temos um loop de feedback que utiliza métricas para ajustar templates de prompts automaticamente.

O grande diferencial aqui não é apenas a reescrita do prompt, mas a capacidade de lidar com um baseline. Se você planeja migrar seu workload de um modelo para outro — ou simplesmente quer extrair mais performance do modelo atual — o sistema realiza testes comparativos, fornecendo estimativas de latência e custo, o que é crucial para times focados em FinOps e eficiência operacional.

Como a ferramenta opera na prática?

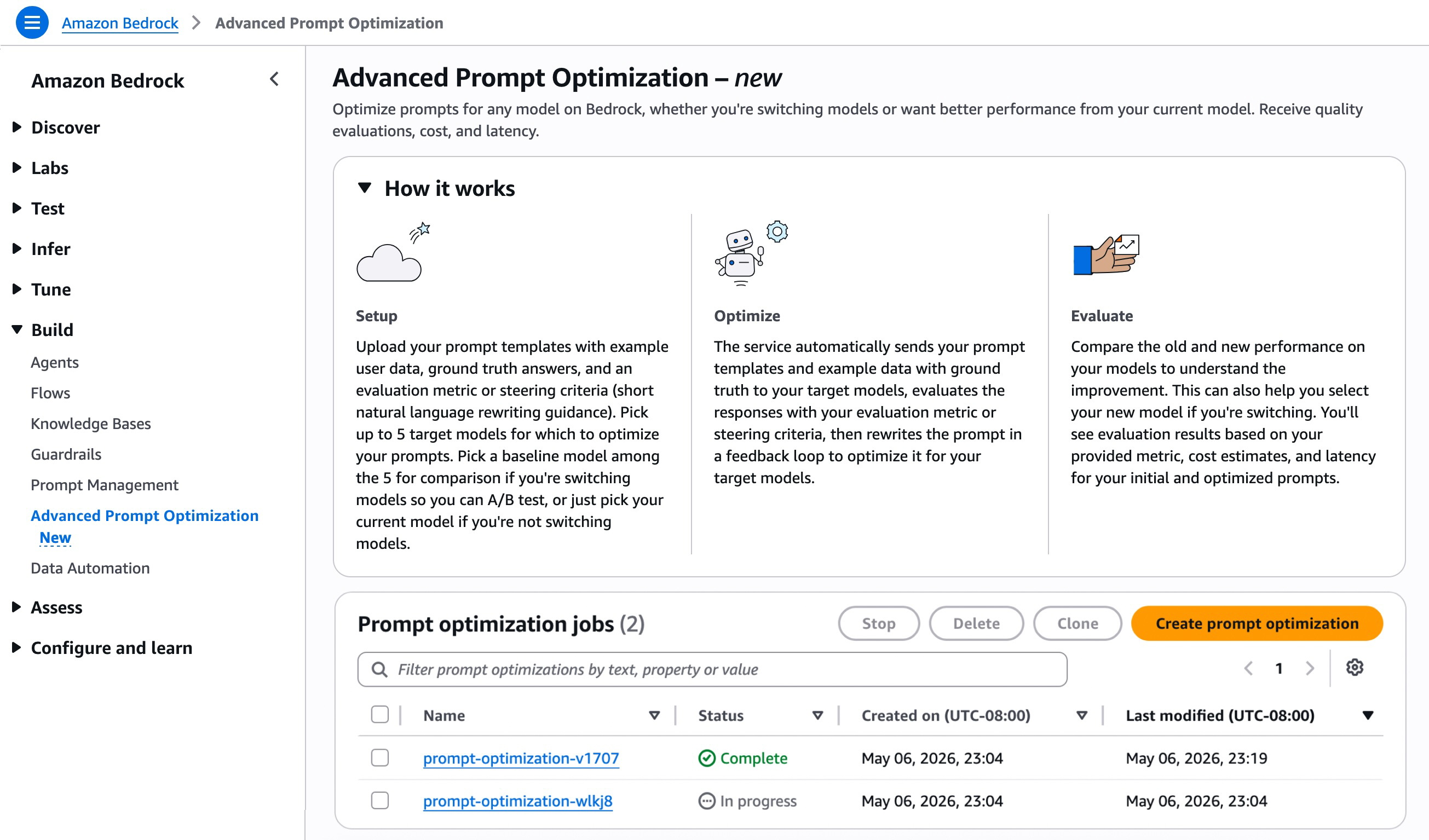

Para iniciar, o console solicita um template em formato JSONL. Esse arquivo é o coração da operação: ele contém as variáveis de entrada, a resposta esperada (ground truth) e as instruções de avaliação. O suporte para inputs multimodais (PDFs e imagens) amplia significativamente o escopo de uso para empresas brasileiras que operam com processamento inteligente de documentos na indústria ou setor financeiro.

Estruturando a avaliação de sucesso

A ferramenta oferece flexibilidade na forma como o sucesso é medido. Dependendo da criticidade da tarefa, você pode escolher:

- AWS Lambda: Ideal para métricas determinísticas (como precisão de um JSON ou acurácia em códigos).

- LLM-as-a-Judge: Utiliza um modelo de referência (como o Claude Sonnet 4.6) para avaliar subjetivamente a saída de um prompt com base em rubricas estruturadas.

- Steering Criteria: Uma abordagem mais simples para quem busca conformidade com o tom de voz da marca ou constraints de segurança sem precisar desenvolver uma lógica complexa de julgamento.

O que considerar antes de implementar?

Para empresas que dependem de alta disponibilidade, é fundamental ressaltar que essa otimização não substitui o monitoramento constante em produção. O acesso à região South America (São Paulo) é uma excelente notícia para reduzir a latência de rede e manter a soberania de dados conforme as exigências locais.

O custo é atrelado apenas aos tokens de inferência consumidos, o que permite rodar testes em larga escala sem surpresas na fatura, desde que você tenha organizado bem seus datasets de avaliação.

Perguntas Frequentes

-

Como essa ferramenta facilita a migração entre modelos?

A ferramenta permite comparar o seu prompt atual com outros modelos escolhidos como alvo, oferecendo uma base de comparação sólida antes da migração definitiva, reduzindo riscos de performance. -

Quais são os métodos de avaliação disponíveis?

Você pode usar funções AWS Lambda com lógica customizada, a técnica de LLM-as-a-Judge com rubricas predefinidas, ou métodos de 'steering criteria' em linguagem natural para guiar o modelo. -

A ferramenta suporta entradas multimodais?

Sim, é possível incluir arquivos PDF ou imagens (PNG, JPG) nos seus templates de prompt, permitindo a otimizização para tarefas que envolvem análise documental e visual.

Artigo originalmente publicado por Channy Yun (윤석찬) em AWS News Blog.