A AWS acaba de anunciar a disponibilidade geral do OpenClaw no Amazon Lightsail. Essa movimentação é estratégica para empresas que buscam autonomia em inteligência artificial sem a complexidade de gerenciar infraestruturas robustas de grande porte logo de início. Ao lançar uma instância OpenClaw, você combina o poder de processamento na nuvem com capacidades de IA personalizadas, podendo conectar canais de mensageria e utilizar o Amazon Bedrock como provedor padrão de modelos de linguagem (LLMs).

O diferencial técnico aqui é a pré-configuração: uma vez concluído o setup, a comunicação com o assistente de IA é imediata, eliminando horas de configuração manual de drivers, bibliotecas de Python ou dependências de sistema.

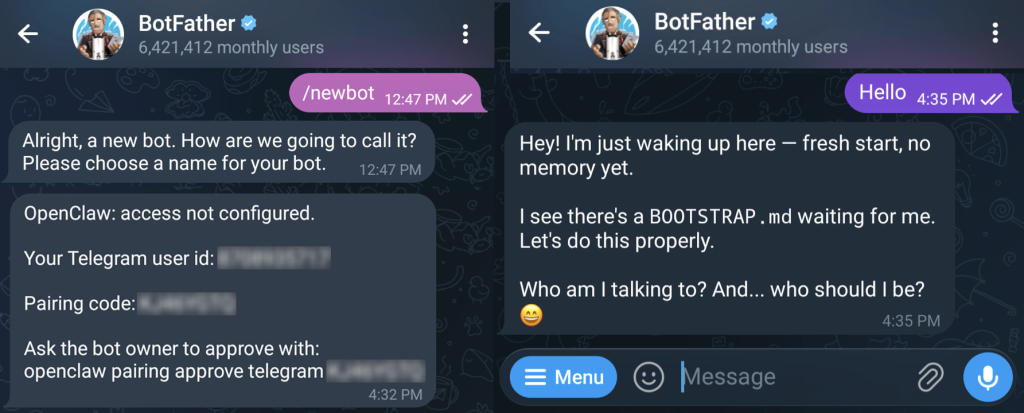

O OpenClaw é um agente de IA autônomo, privado e self-hosted. Diferente de chatbots genéricos, ele atua como um assistente digital executando tarefas práticas — como gerenciar e-mails, realizar navegação web para coleta de dados e organizar arquivos — integrando-se diretamente a plataformas como WhatsApp, Discord ou Telegram através de APIs de mensageria.

Até então, rodar o OpenClaw exigia instâncias Amazon EC2 configuradas do zero, o que trazia desafios de segurança e manutenção para times menores. A chegada ao Lightsail resolve esse gargalo operacional, oferecendo um ambiente isolado e seguro de forma simplificada.

OpenClaw no Amazon Lightsail na prática

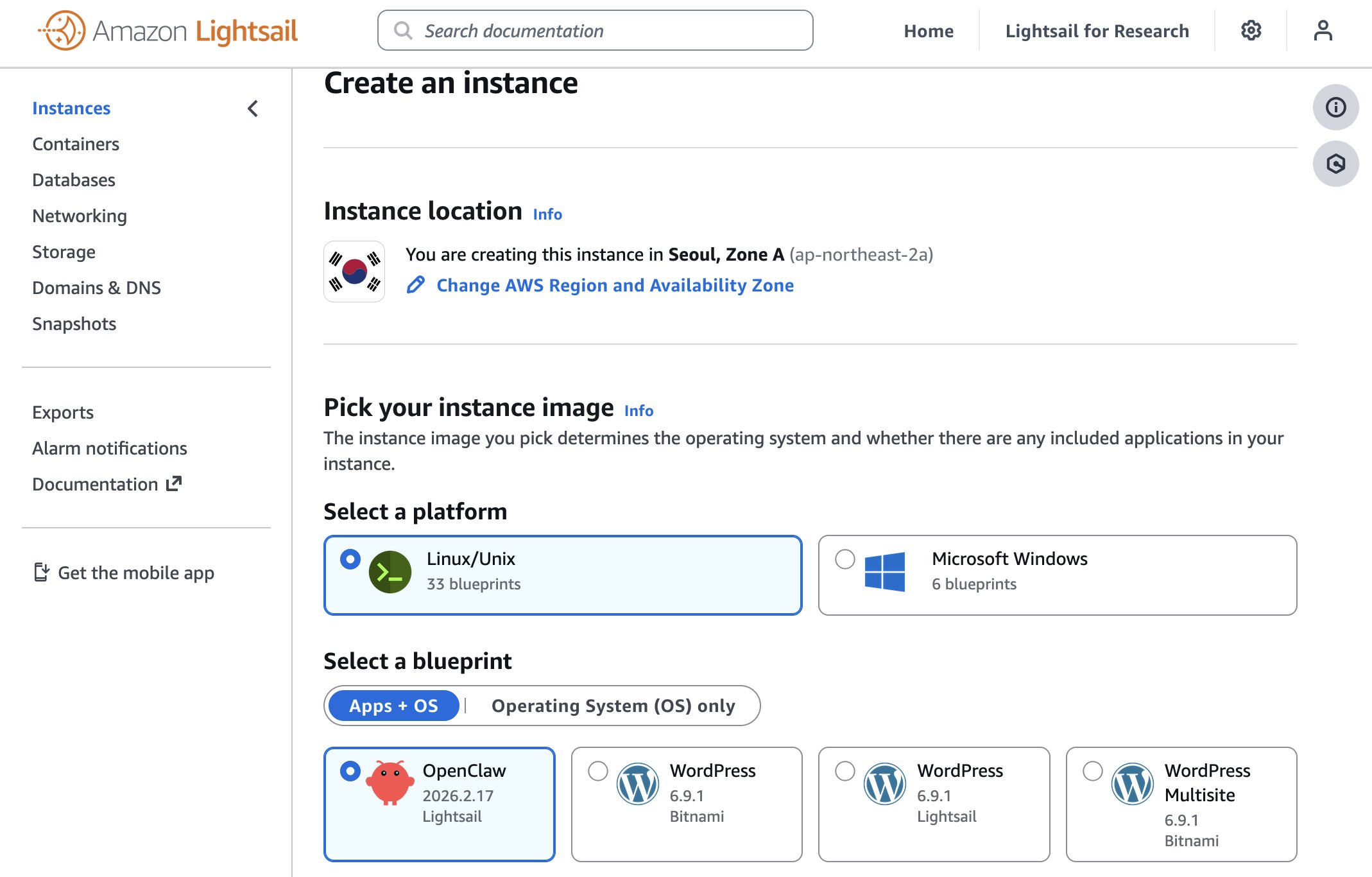

Para iniciar, acesse o console do Amazon Lightsail e selecione Create instance. Após definir a Região AWS (recomendamos avaliar a latência e os custos de transferência de dados para o Brasil) e a Availability Zone, selecione a plataforma Linux/Unix e escolha o blueprint do OpenClaw.

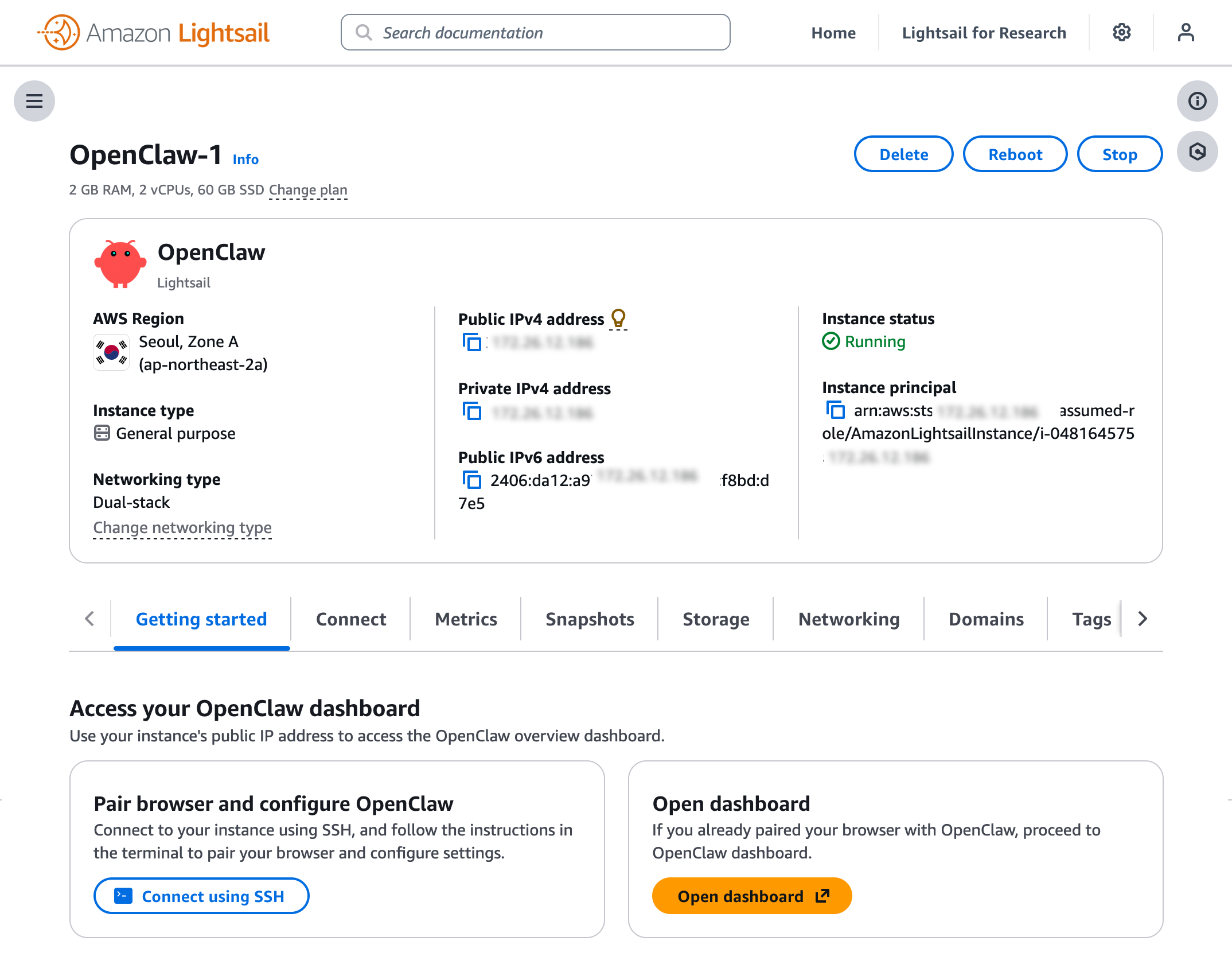

Para empresas que buscam performance otimizada em ambientes de produção, o plano de 4 GB de memória é o ponto de partida ideal. Após nomear a instância e clicar em Create instance, o ambiente estará em estado de Running em poucos minutos.

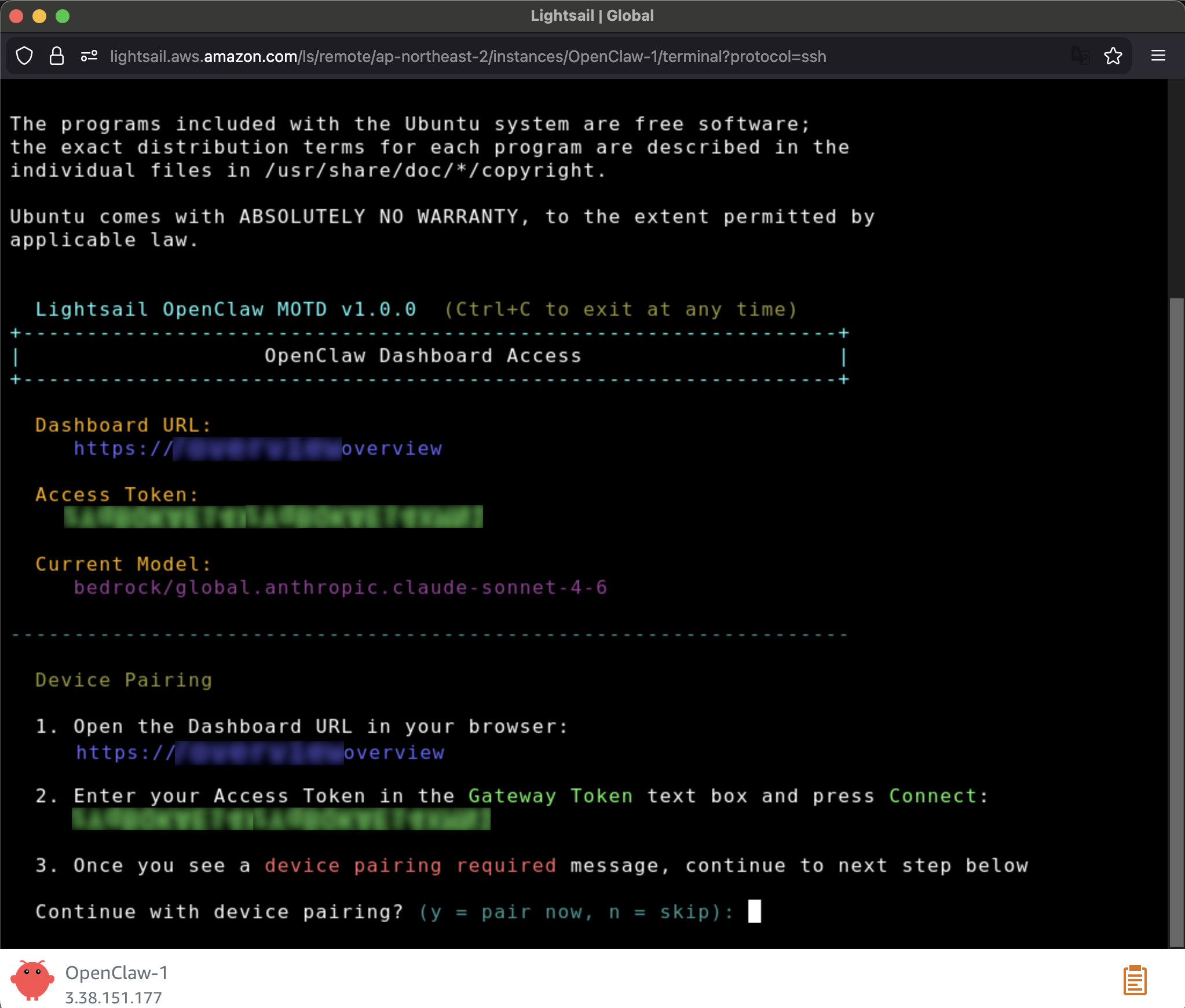

Um passo crucial de segurança é o emparelhamento do browser. O Lightsail cria uma conexão segura entre sua sessão local e a instância remota. Para isso, utilize a opção Connect using SSH na aba Getting started.

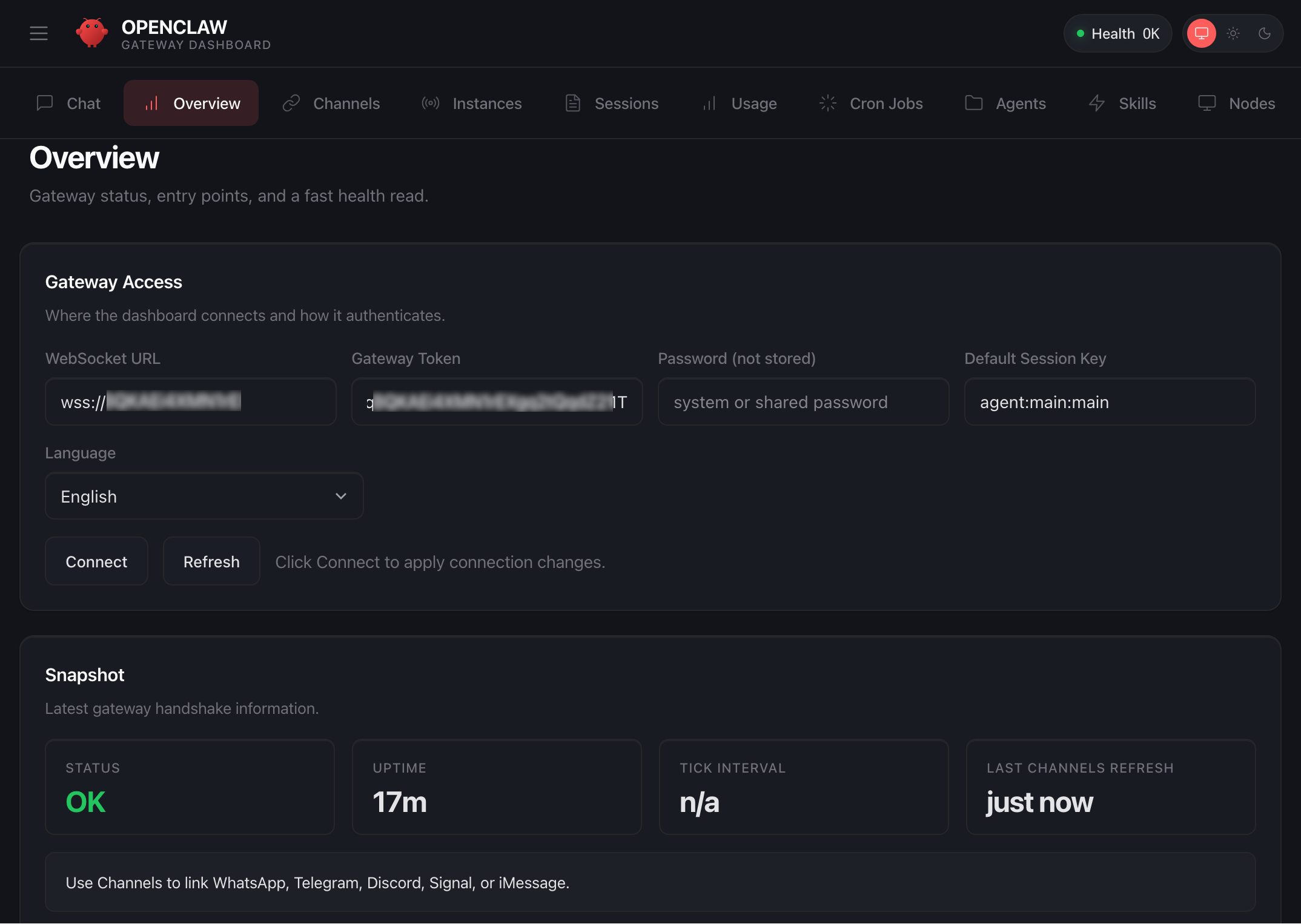

O terminal exibirá a URL do dashboard e as credenciais de segurança. Copie o access token e insira-o no campo Gateway Token do painel do OpenClaw.

No terminal SSH, confirme o pareamento do dispositivo (pressionando y e a). Quando o status OK aparecer no dashboard, a conectividade estará estabelecida.

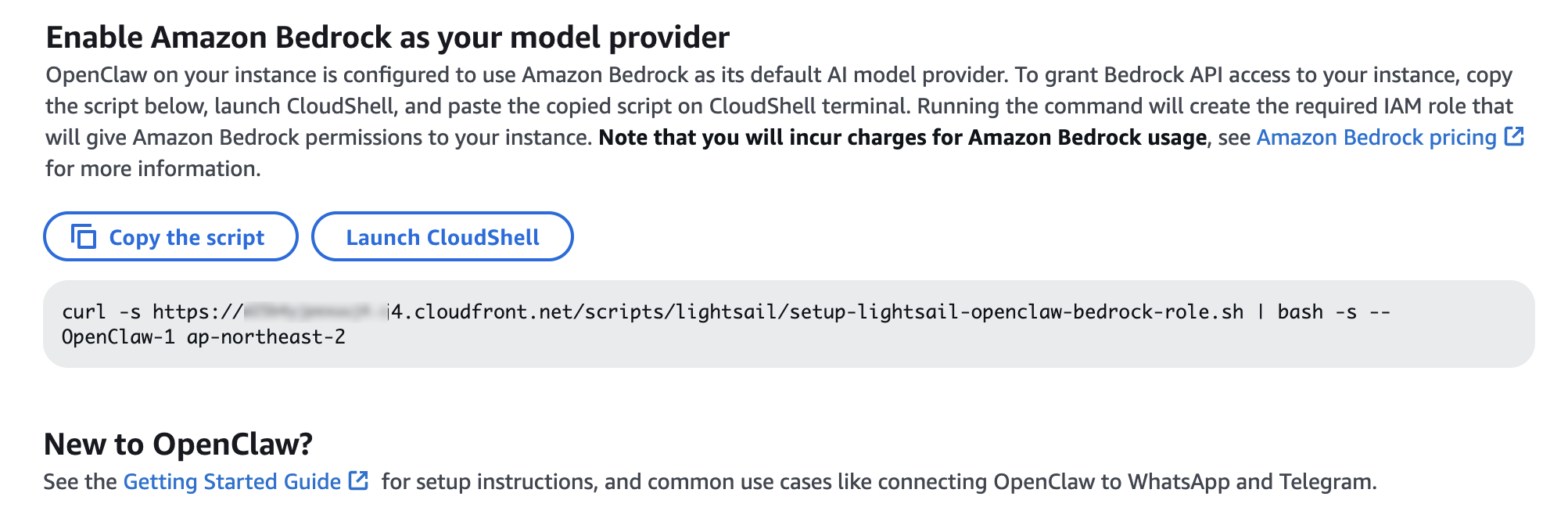

Como a instância é otimizada para o ecossistema AWS, a integração com o Amazon Bedrock é o próximo passo lógico. Basta executar o script fornecido na aba Getting started dentro do AWS CloudShell para conceder as permissões necessárias e ativar as APIs de modelos como Claude, Llama ou Jurrasic.

Com a configuração finalizada, o agente está pronto para operar via chat ou ser integrado a aplicativos de mensagens externos.

Análise Estratégica: O que gestores devem considerar

Sob uma ótica de FinOps e SecOps, há pontos fundamentais para empresas brasileiras:

- Gestão de Permissões (IAM): O script de setup cria uma IAM role específica para o Bedrock. É possível customizar essas permissões, mas qualquer alteração deve ser feita com cautela para não interromper cadeias de inferência do agente.

- Modelo de Custo: No Lightsail, o custo da instância é previsível (on-demand hourly), mas o processamento das mensagens no Bedrock segue o modelo de token-based pricing. Se você optar por modelos de terceiros via AWS Marketplace, esteja atento a taxas de software adicionais que podem impactar seu orçamento de cloud.

- Segurança de Gateway: Operar agentes autônomos amplia a superfície de ataque. Recomendamos nunca expor o gateway do OpenClaw diretamente à internet pública sem proteção. Trate o token de autenticação como uma secret crítica: rotacione-o frequentemente e utilize variáveis de ambiente em vez de hardcoding em arquivos de configuração.

Disponibilidade

O OpenClaw no Amazon Lightsail já está disponível em todas as regiões comerciais da AWS onde o serviço Lightsail opera. Para organizações brasileiras que exigem residência de dados ou menor latência, a região de São Paulo (sa-east-1) deve ser priorizada sempre que os modelos do Bedrock necessários estiverem disponíveis localmente.

Artigo originalmente publicado por Channy Yun (윤석찬) em AWS News Blog.