No Google Cloud Next, a gigante de Mountain View detalhou as novas capacidades do Google Distributed Cloud (GDC), sinalizando uma mudança clara na arquitetura de "neocloud" soberana. Para empresas brasileiras que operam em setores altamente regulados — como financeiro, saúde e manufatura — o GDC não é apenas uma oferta de hardware: é uma solução estratégica para resolver o dilema entre a inovação via IA generativa e a necessidade rigorosa de soberania de dados.

Atualmente, o GDC é estruturado em dois modelos principais: o GDC air-gapped, focado em cenários de total isolamento e conformidade extrema, e o GDC connected, que mantém o ciclo de vida de software gerenciado pelo Google, mas rodando em infraestrutura própria. Esta abordagem elimina a necessidade de construir sistemas legados complexos e dispendiosos, permitindo que times de engenharia foquem em workloads de IA sem a carga operacional (toil) de manter o stack subjacente.

Infraestrutura de IA Gerenciada

O desafio de rodar IA on-premises reside na imprevisibilidade da performance. As inovações anunciadas atacam diretamente esse gargalo:

- Poder Computacional: A integração das GPUs NVIDIA Blackwell (HGX B200 e B300) com 5th-gen NVIDIA NVLink eleva a banda de comunicação a níveis de data center. Para casos de uso que exigem alta performance de inferência, essa arquitetura é um divisor de águas.

- Famílias de Máquinas: A chegada das instâncias A4 (voltadas a aceleradores) para tarefas intensivas de inferência e das famílias M2 e M3 (otimizadas em memória) para ERPs e Analytics complexos permite um redimensionamento de recursos muito mais preciso.

- Storage: O salto de 1PB para 6PB de object storage por zona, aliado a um aumento de 10x na capacidade de IOPS (30 IOPS/GB), endereça limitações históricas que travavam pipelines de dados locais.

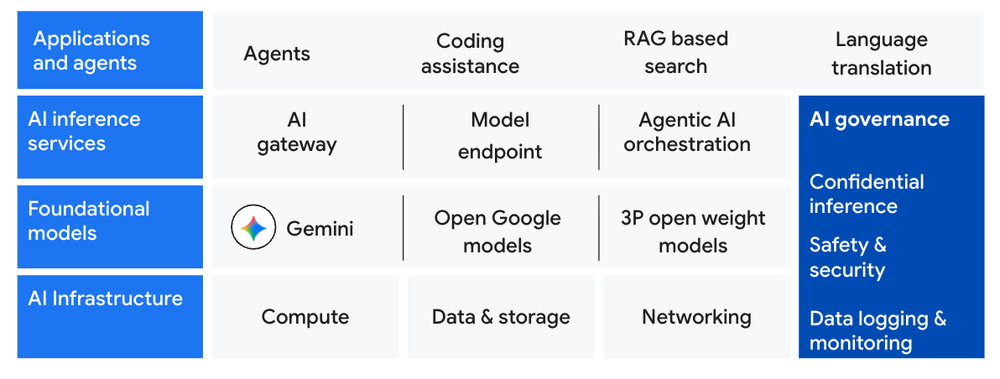

Modelos Fundacionais e o Novo AI Gateway

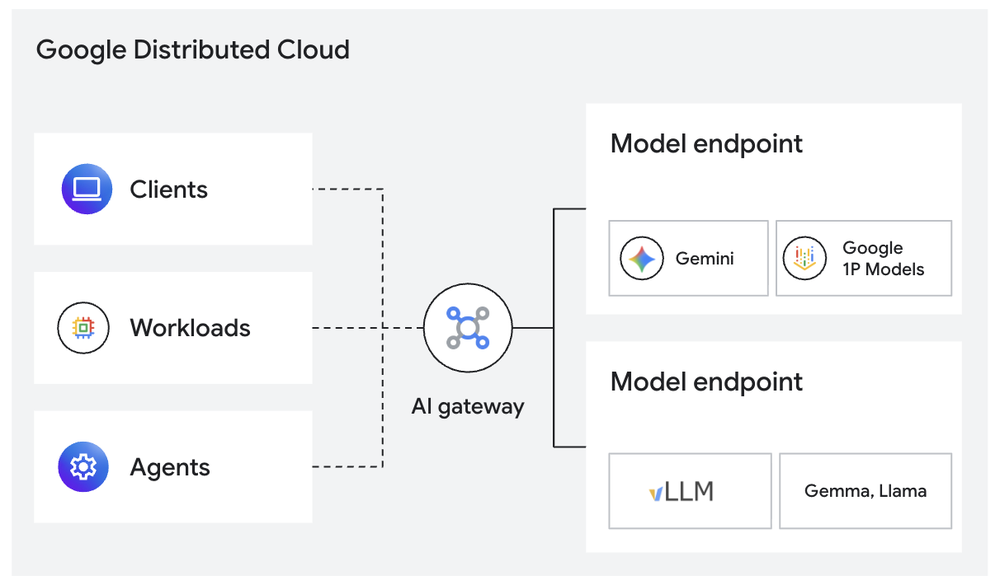

Trazer o Gemini para o ambiente on-premises, com o suporte de hardware otimizado, permite que empresas processem dados sensíveis localmente, evitando custos de egress e problemas de latência. O grande diferencial prático aqui é a introdução do AI Gateway.

Este middleware atua como o controle central para modelos rodando localmente, oferecendo:

- Roteamento Dinâmico: Decisões baseadas em custo, latência e acurácia, em vez de lógica hard-coded.

- Load Balancing Inteligente: Otimização de uso de GPUs conforme a carga.

- Observabilidade e Compliance: Rastreabilidade completa de cada chamada, essencial em auditorias regulatórias no Brasil.

Agentes e a Jornada Operacional

O anúncio também contempla uma arquitetura voltada para agentes de IA operando sobre Kubernetes. Em um cenário corporativo, isso transforma o GDC em uma plataforma de execução de fluxos de trabalho autônomos. A capacidade de manter esses agentes rodando dentro de um perímetro de segurança delimitado (Customer Organization) é o fechamento do círculo de soberania que muitos líderes de tecnologia buscavam.

Para o mercado brasileiro, o GDC representa uma oportunidade de descentralizar o processamento sem abrir mão do ecossistema de gestão do Google. A estratégia deve ser focada em identificar quais workloads de inferência se beneficiam mais da baixa latência do edge computing e, simultaneamente, colocar a observabilidade de IA como pilar central de governança desde o dia um.

Artigo originalmente publicado por Muninder SambiVP, Google Distributed Cloud em Cloud Blog.