Abordagem automatizada para implementar a Medallion Architecture no Azure Databricks

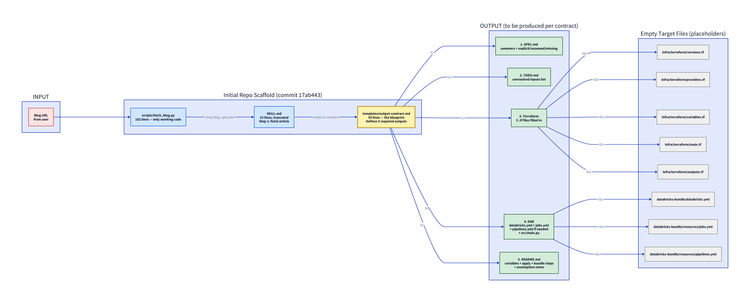

Este artigo detalha como utilizar o GitHub Copilot para automatizar a implementação de uma Medallion Architecture no Azure Databricks. A conclusão principal é que, para obter sucesso na automação via LLM, é fundamental manter a separação de responsabilidades entre infraestrutura (Terraform) e workloads (Databricks Asset Bundles), utilizando contratos rigorosos de saída e arquivos de 'TODO' para gerenciar placeholders, evitando assim que ferramentas de IA criem, por conta própria, valores inseguros ou imprecisos.

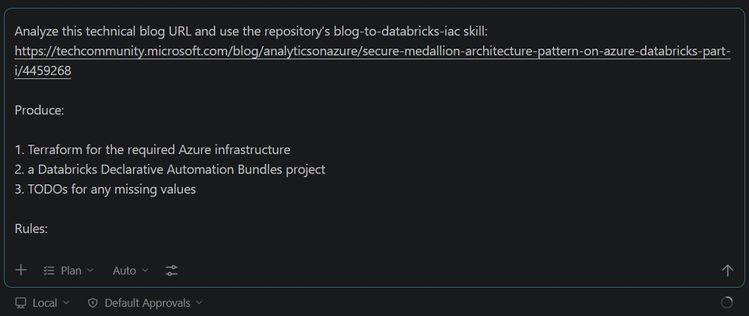

Esta análise foca na implementação do padrão Medallion Architecture utilizando agentes de IA para transformar especificações técnicas em código de infraestrutura e pipelines de dados operacionais no ecossistema Azure. O objetivo é demonstrar uma abordagem spec-driven para garantir previsibilidade e estabilidade no deployment.

Separar a plataforma do workload

No design de soluções em nuvem, a modularização é vital. Para este padrão, a automação foi segmentada:

- Terraform: Responsável pelos elementos de fundação (networking, storage, identidades, secret scopes e configurações de workspace).

- Databricks Asset Bundles (DAB): Dedicado aos workloads (execuções de notebooks, job clusters, pipelines e deployments específicos de ambiente).

Ferramentas de IA, sem diretrizes explícitas, tendem a criar configurações monolíticas e excessivamente acopladas. Para evitar isso, aplicamos um contrato de implementação:

- Inferir a arquitetura a partir do conteúdo técnico (artigos ou especificações).

- Distinguir o que é explícito do que é inferido.

- Segregar responsabilidades entre Terraform e Bundles.

- Substituir valores sensíveis por placeholders em casos de incerteza (TODO markers).

Este último ponto é o mais importante para a segurança: uma página de documentação não deve ditar IDs de subscrição, hostnames ou segredos em produção. A automação deve, por norma, delegar essa responsabilidade ao operador via checklist.

O que são Skills e por que fazem sentido para engenharia de dados?

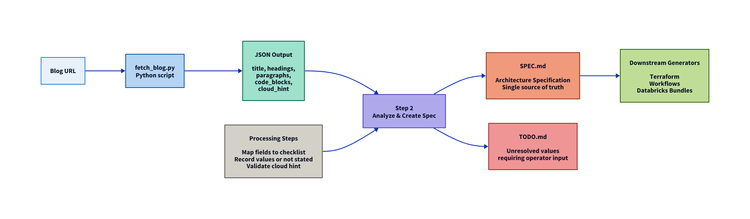

Skills no contexto do GitHub Copilot são módulos de prompt reutilizáveis e estruturados. Eles não apenas "geram código", mas orquestram o fluxo de trabalho:

- Consumo do recurso (URL do artigo/doc).

- Extração de metadados, estrutura e snippets de código.

- Normalização para uma especificação técnica.

- Design da saída (onde cada recurso deve ser provisionado).

- Validação da estrutura de projeto.

- Geração de logs sobre pendências em

TODO.md.

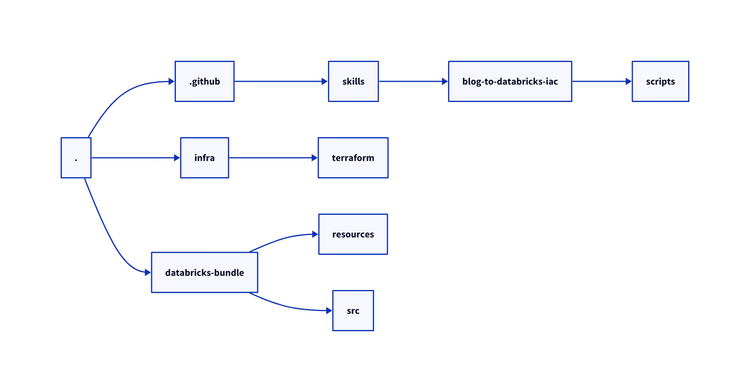

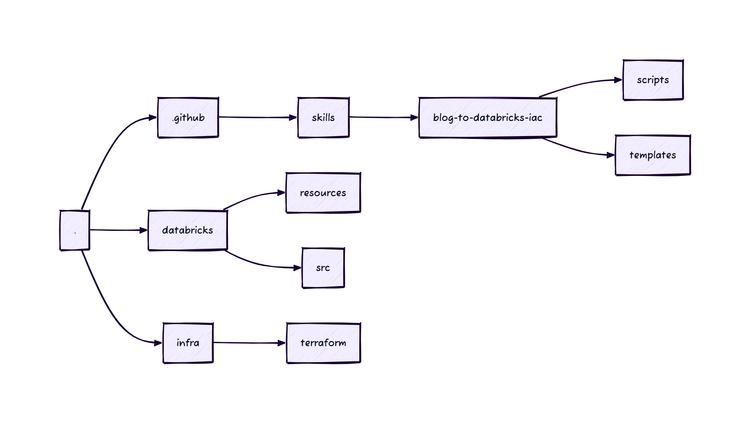

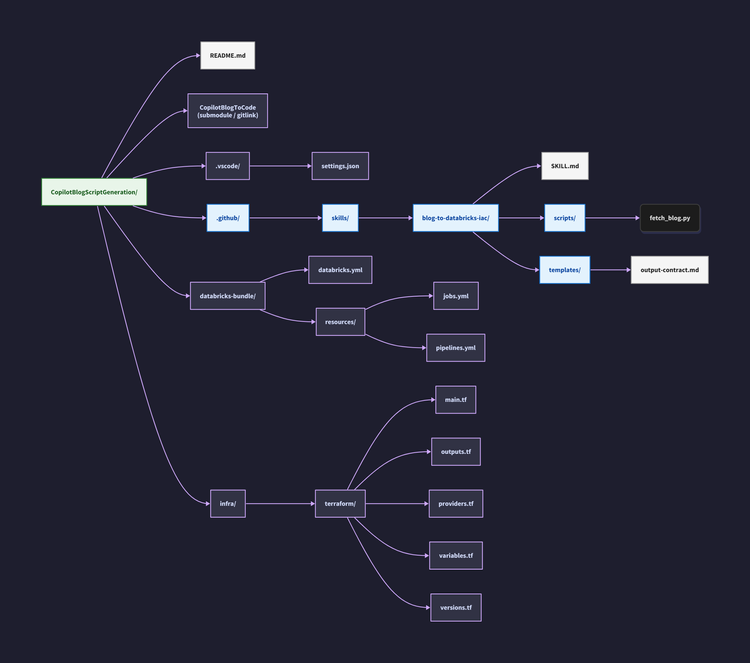

Passo a passo: Organizando o repositório

Para manter a rastreabilidade e evitar poluição no código, siga a estrutura abaixo:

- Clone do repositório base.

- Definição da hierarquia de pastas:

.github/skills/,infra/terraform/,databricks-bundle/. - Orquestrador (SKILL.md): O componente principal que coordena o fluxo.

- Script de normalização (fetch_blog.py): Lê o conteúdo web e converte para o formato JSON otimizado.

Otimização e validação do fluxo

É essencial implementar uma camada de checagem. O orquestrador utiliza um arquivo de checklist (localizado em .github/skills/.../references/blog-analysis-checklist.md) para confrontar o que a IA gerou com o que é tecnicamente esperado. Cada item ausente é automaticamente transformado em uma entrada no TODO.md, garantindo que o engenheiro responsável tenha um roteiro manual de intervenção antes de aplicar o deployment.

Considerações sobre o contrato de saída

Para evitar que o modelo sofra de "alucinações estruturais", defina um output-contract.md logo na primeira versão do projeto. Todos os commits subseqüentes devem validar se o formato definido neste arquivo está sendo mantido. A adição de um script de reset (reset_generated.py) é uma boa prática que permite remover a infraestrutura gerada automaticamente pelo agente sem destruir o andaime (scaffolding) do projeto.

Validando o plano antes da execução

Antes de qualquer comando apply, execute o planejamento via Copilot console. O plano deve listar explicitamente as fases (ex: Build Terraform foundations, Build Databricks and Unity Catalog infrastructure, Build Lakeflow jobs). Se o plano não atender aos critérios de segurança, como por exemplo, a segregação de identidades por camada (Bronze/Silver/Gold), o orquestrador deve ser instruído a realizar o rollback ou a reconfiguração da skill.

Perguntas Frequentes

-

Por que separar Terraform de Databricks Asset Bundles (DAB)?

Separar essas camadas garante que a infraestrutura (rede, identidades, Unity Catalog) seja gerenciada de forma centralizada e previsível pelo Terraform, enquanto os fluxos de dados, jobs e clusters (workloads) fiquem encapsulados nos Bundles, facilitando a manutenção e a escalabilidade. -

Como evitar que o LLM invente nomes, subnets ou IDs em arquivos de infraestrutura?

A estratégia correta é implementar uma política rigorosa de não inventar valores. O uso de um arquivo 'TODO.md' atua como um contrato, forçando a IA a inserir marcadores de posição (placeholders) sempre que o dado for específico de um ambiente, garantindo que o engenheiro valide essas informações antes da implementação. -

Quais são as principais limitações ao usar agentes para gerar código de infraestrutura?

As limitações incluem a janela de contexto do modelo, o risco de non-determinism na geração de código e o 'boundary leakage', onde o modelo assume configurações incorretas. Manter o escopo da 'skill' de IA bem definido e usar validações como 'lint' e 'diff' são passos fundamentais para mitigar esses problemas.

Artigo originalmente publicado em Azure Updates - Latest from Azure Charts.