A forma como times de engenharia constroem e operam sistemas está mudando drasticamente. Observabilidade não é mais uma tarefa exclusiva de humanos interpretando dashboards ou escrevendo arquivos de configuração manualmente; cada vez mais, agentes de IA interagem com o pipeline de dados, auxiliando na escrita de código, otimização de deployments e investigação de incidentes.

Para empresas brasileiras, que buscam eficiência operacional e redução de riscos, essa transição para uma observabilidade mediada por IA é uma oportunidade estratégica. O desafio, contudo, tem sido a soberania dos dados e a fragmentação de ferramentas. Com as novas atualizações anunciadas, o Grafana Assistant deixa de ser uma exclusividade do SaaS e passa a ser uma ferramenta que pode ser integrada ao seu ecossistema, independentemente de onde sua stack de monitoramento esteja hospedada.

Levando o Assistant do Cloud para qualquer lugar

No GrafanaCON 2026, foi anunciado que o poder do Grafana Assistant agora se estende aos usuários de Grafana Enterprise e Grafana OSS. Para times que operam em modelos de nuvem privada ou ambientes altamente regulados, isso elimina a barreira do vendor lock-in e permite que a inteligência artificial analise telemetria e código em tempo real, sem que você precise mover toda a carga de trabalho para uma nuvem pública.

Usuários de instâncias self-managed podem conectar seu ambiente ao Grafana Cloud com uma configuração de um clique. O Assistant está disponível no plano gratuito do Grafana Cloud, permitindo um teste de baixo risco e alto impacto para times de engenharia que buscam acelerar o MTTR (Mean Time To Resolution).

Customização e Automação com Skills

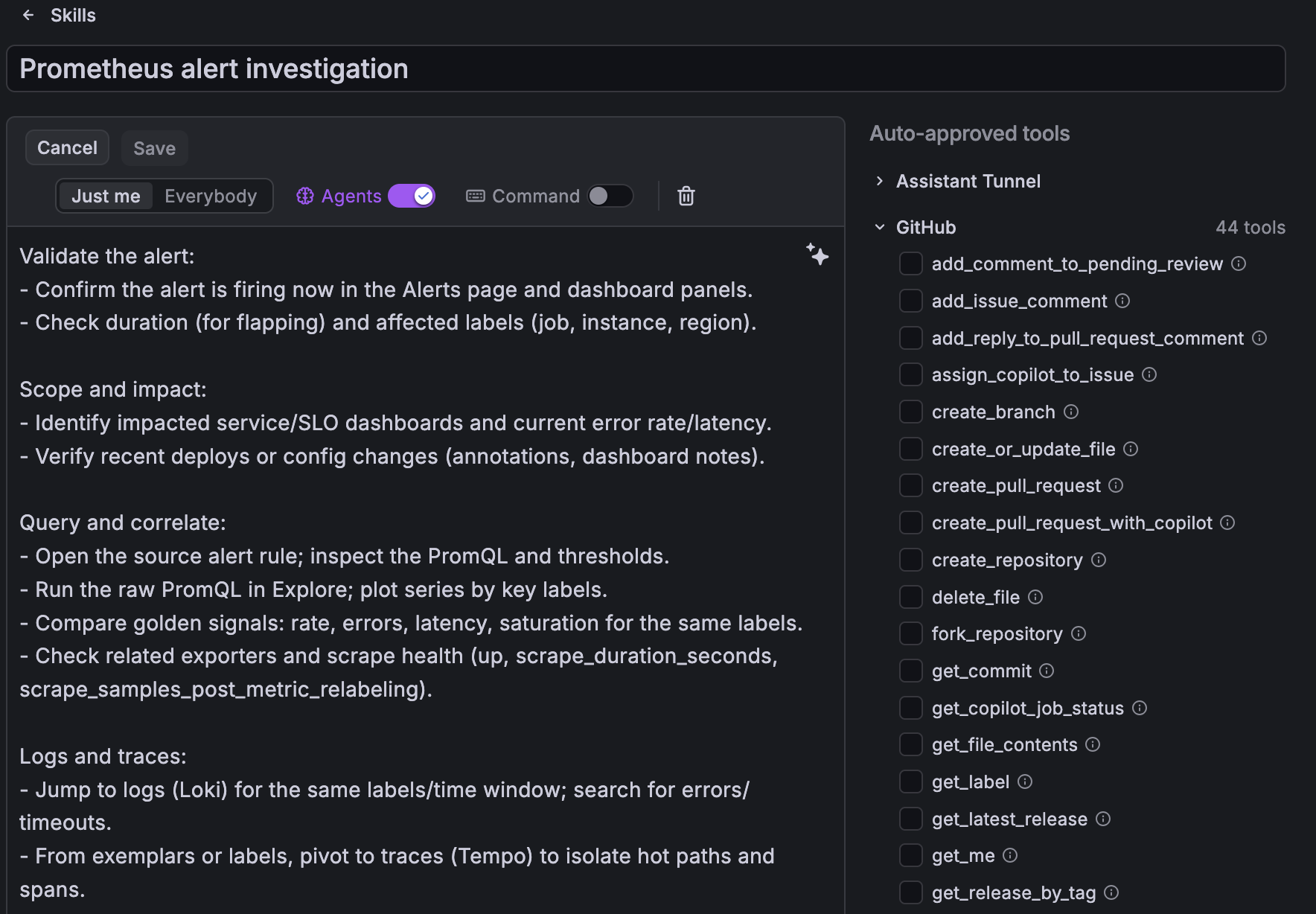

Cada organização possui um playbook de SRE diferente. O grande salto aqui é a disponibilidade geral das Assistant Skills. Elas permitem codificar o conhecimento tribal da equipe — como lidar com um alerta específico ou como investigar uma latência elevada — em instruções que a IA entende e executa.

Ao pairar o recurso auto-approve com o Assistant Investigations, é possível construir, na prática, um pipeline de remedição automatizada. Imagine um cenário onde o Grafana detecta um erro, o Assistant diagnostica, abre um PR no GitHub e notifica o time no Slack. Isso reduz o context switching e libera os engenheiros para o desenvolvimento de novas features.

Integração com fluxos existentes

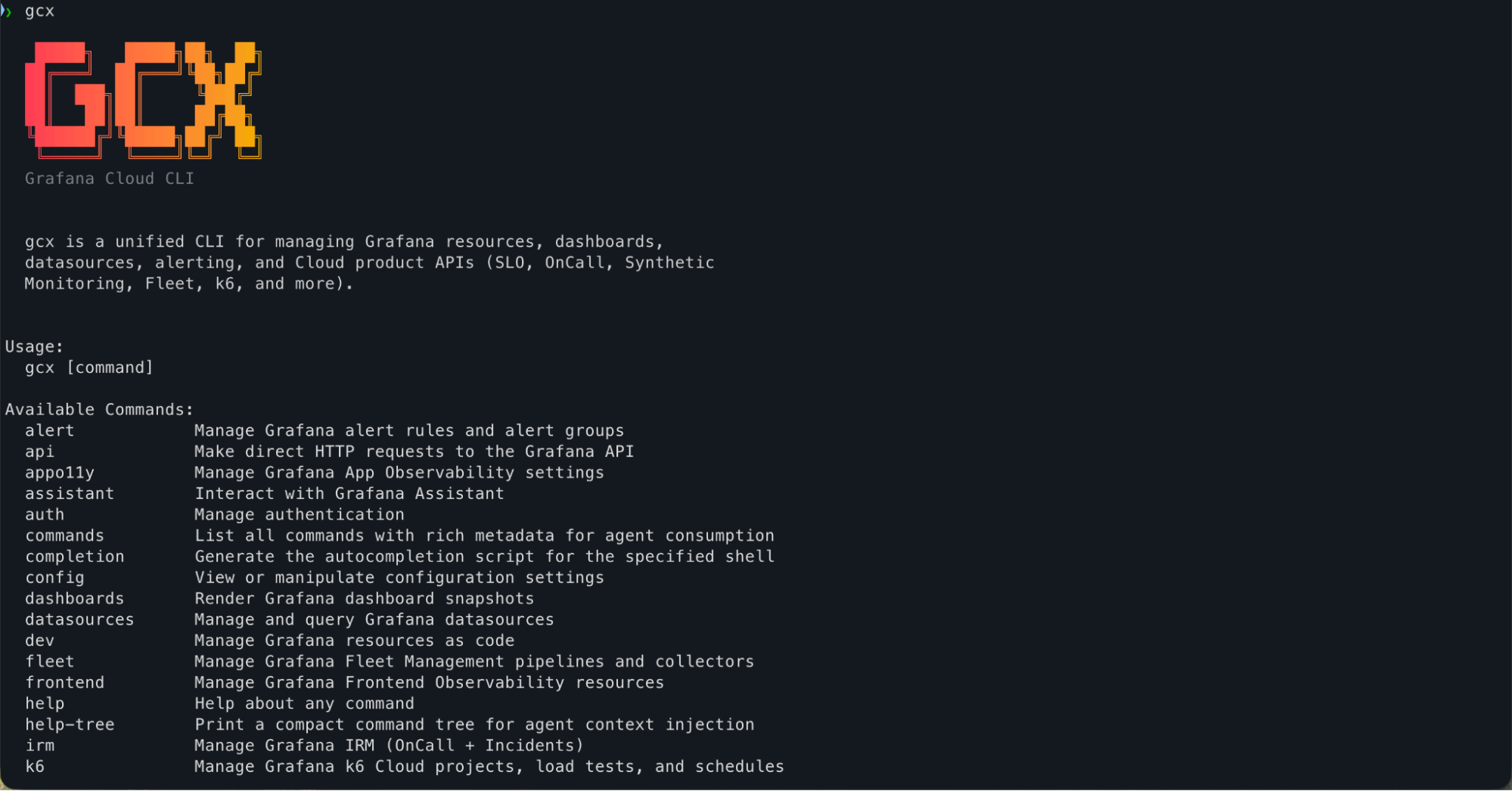

Não queremos forçar os desenvolvedores a dependerem apenas da UI do Grafana. A expansão de acesso ao Assistant via CLI, Slack e Microsoft Teams mostra um movimento consciente em direção ao GitOps e fluxos de trabalho já estabelecidos. Com a nova ferramenta gcx (gRPC CLI para o Grafana), é possível conectar o editor do desenvolvedor diretamente à stack de produção. Isso significa, por exemplo, criar um service instrumentado que já nasce com a consciência de métricas que importam, tudo via linha de comando.

O futuro da sua estratégia FinOps e SecOps

O uso do data source Infinity permite que o Assistant envie requisições GET ou POST para qualquer API. Isso transforma o agente em um nó central, capaz de correlacionar métricas de sistemas legados, logs de aplicações em containers e até dados de custos na nuvem (FinOps). A capacidade de realizar inference local ou via regiões específicas atende, inclusive, a exigências de conformidade de dados (como LGPD), ponto crucial para empresas brasileiras de setores regulados.

As atualizações recentes — como a nova visualização de workspace, runtime Python para processamento de alto volume e integrações nativas com mais de 50 fontes — colocam a observabilidade em um patamar de maturidade onde o erro passa a ser antecipado, não apenas reagido.

Artigo originalmente publicado por Maurice Rochau em Grafana Labs blog on Grafana Labs