A rápida ascensão de workloads de inteligência artificial (IA) está forçando uma reavaliação fundamental na infraestrutura de data centers. Para times de engenharia e tomadores de decisão, o desafio é claro: como manter a escalabilidade e a performance de clusters de GPU de alta densidade sem comprometer a eficiência operacional e os compromissos de sustentabilidade (carbono e consumo de água)?

Atualmente, observamos uma divergência técnica no hardware: enquanto servidores de computação de propósito geral, storage e rede permanecem majoritariamente refrigerados a ar, os aceleradores de IA modernos ultrapassam a barreira de 1 kW por unidade, tornando o resfriamento a ar logisticamente ineficiente e proibitivo. Como o ar possui baixa capacidade térmica, a mudança para o resfriamento líquido tornou-se obrigatória para evitar gargalos físicos e térmicos.

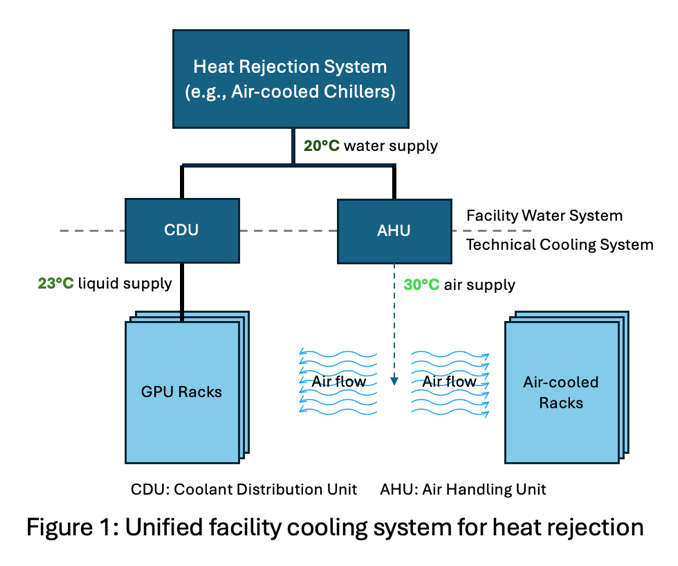

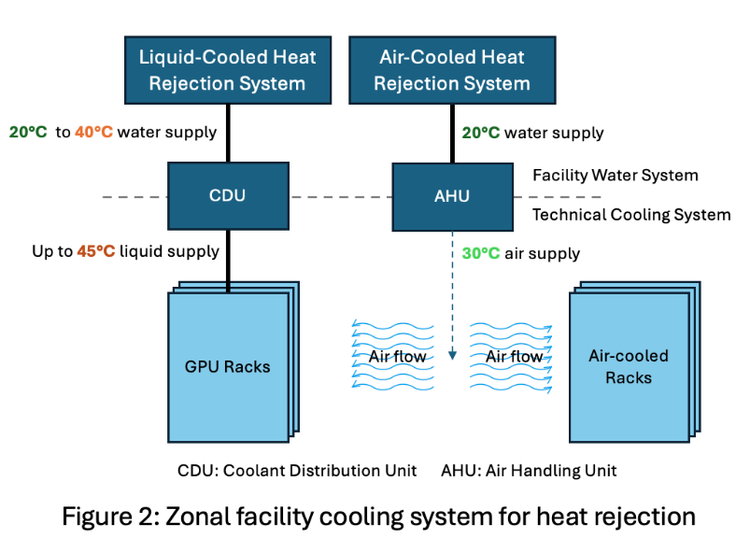

O problema estratégico surge quando tentamos manter essas tecnologias coexistindo em uma infraestrutura de água, ou Facility Water System (FWS), unificada. Em uma rede de temperatura única, o hardware de GPU pode ser sub-resfriado (o que é ineficiente em termos de energia) ou, inversamente, o hardware de propósito geral pode sofrer com temperaturas inadequadas. Essa "zona de conforto" técnica é um desperdício explícito de OPEX. A convergência para o Zonal Cooling é a resposta dos grandes provedores para modularizar essa entrega de temperatura.

O conceito de Zonal Cooling

O Zonal Cooling não é apenas uma redundância mecânica; é uma estratégia de design que utiliza diversos ciclos de água independentes, cada um configurado para perfis térmicos específicos. Ao separar o loop de resfriamento para o hardware de alta densidade (aceleradores/GPUs) do loop de refrigeração para equipamentos de propósito geral (air-cooled), o operador deixa de realizar o esforço desnecessário de refrigerar tudo pelo "menor denominador comum".

Para empresas brasileiras, especialmente as que operam em cenários de multi-cloud ou que mantêm infraestruturas híbridas, entender essa mudança é vital por três razões:

- Eficiência Operacional (PUE): A otimização do resfriamento permite que o Power Usage Effectiveness (PUE) atinja patamares mais baixos, reduzindo diretamente o desperdício de energia. Implementar esses padrões em escala ajuda a alcançar metas de sustentabilidade, frequentemente exigidas por políticas de governança corporativa.

- Densidade e Escalabilidade: Com um resfriamento mais direcionado, é possível aumentar o número de servidores dentro do mesmo envelope de energia disponível, maximizando o ROI de cada rack instalado.

- Future-Proofing: O zonal cooling oferece a flexibilidade necessária para que o data center se adapte a novas gerações de chips que podem ter exigências térmicas distintas (como a adoção de tecnologias de microfluidics), sem a necessidade de uma reforma completa da infraestrutura física.

Perspectiva de Longo Prazo

A adoção de zonas de resfriamento (seja em nível de facility, de linha, de rack ou de chip) representa a próxima fronteira da engenharia de infraestrutura. Para o tomador de decisão, a recomendação é clara: a infraestrutura básica não é mais um commodity estático. A forma como seu provedor de cloud ou sua infraestrutura privada gerencia o calor é um determinante direto da escalabilidade dos seus modelos de inteligência artificial. Monitorar a adoção dessas arquiteturas e a maturidade de hardware que suporta resfriamento líquido será um diferencial crítico nos próximos anos.

Artigo originalmente publicado em Azure Updates - Latest from Azure Charts.