À medida que a adoção de Inteligência Artificial se consolida nas empresas, um gargalo crítico surge silenciosamente: a gestão e distribuição confiável de arquivos de pesos de modelos em larga escala. Embora os pesos sejam os pilares que sustentam tanto os pipelines de treinamento quanto os de inferência, a infraestrutura responsável por mover esses pesados artefatos é, muitas vezes, tratada como um componente secundário ou improvisado.

Este artigo analisa os desafios operacionais de gerenciar artefatos de modelos de IA em nível empresarial, apresentando uma abordagem cloud-native que transpõe as melhores práticas de entrega de software — como versionamento, imutabilidade e GitOps — para o ecossistema de dados de IA.

O gap que ninguém nota — até que a produção pare

O abismo da era Cloud Native: A maioria das soluções atuais de armazenamento de modelos de Machine Learning foi concebida sem considerar as particularidades da entrega nativa em Kubernetes. Dentro do ecossistema da CNCF, projetos como ModelPack, ORAS, Harbor e Dragonfly buscam preencher essa lacuna, tratando os modelos como artefatos de software tradicionais.

Hoje, empresas operam infraestrutura de IA rodando sobre Kubernetes, mas a gestão de seus modelos ainda é arcaica. Enquanto containers seguem padrões rigorosos de versionamento em OCI registries, com scanning de segurança e rollback simplificado, os pesos dos modelos são frequentemente distribuídos via scripts ad hoc, cópias manuais entre buckets de storage ou sistemas de arquivos compartilhados inseguros. Essa disparidade gera fragilidade em deploys, riscos à segurança e um overhead operacional insustentável conforme o ambiente escala.

Quando seu modelo pesa mais que sua aplicação

Modelos de fundação modernos superam facilmente a casa dos gigabytes ou mesmo terabytes. Um modelo LLaMA-3 70B quantizado gira em torno de 140 GB; modelos multimodais de frontilha podem exceder 1 TB. Não estamos falando de arquivos para o Git, mas de artefatos que exigem estratégias dedicadas de storage, protocolos de transferência eficientes e controle de acesso granular. Os desafios centrais aqui são: storage em escala, velocidade de distribuição e reprodutibilidade — garantindo que cada deployment possa ser auditado até um artefato imutável.

Três caminhos comuns — e por que nenhum resolve o problema

| Git LFS (Hugging Face Hub) | Object Storage (S3, MinIO) | Distributed Filesystem (NFS, CephFS) | |

| Pros | Controle de versão nativo (branches, tags e histórico). | Oferta standard em cloud providers. Integração com vLLM/SGLang. | Compatível com POSIX. Custo de integração baixo. |

| Cons | Adaptação precária para ambientes cloud-native. Ineficiências de transporte do Git para arquivos gigantes. | Falta de metadados estruturados. Gestão de versão limitada. | Falta de metadados estruturados. Alta complexidade operacional no gerenciamento do cluster. |

Repensando o pipeline de entrega: modelos merecem algo melhor que um Shell Script

A abordagem discutida aqui trata os pesos de modelos de IA como artefatos OCI (Open Container Initiative) de primeira classe, empacotando-os exatamente nos mesmos Registries onde ficam as imagens da sua aplicação. Isso permite que a entrega de modelos se beneficie de todo o ferramental de container: supply chain security, assinaturas, GitOps e pulling nativo do Kubernetes.

Se enviamos código como containers, por que não fazer o mesmo com modelos?

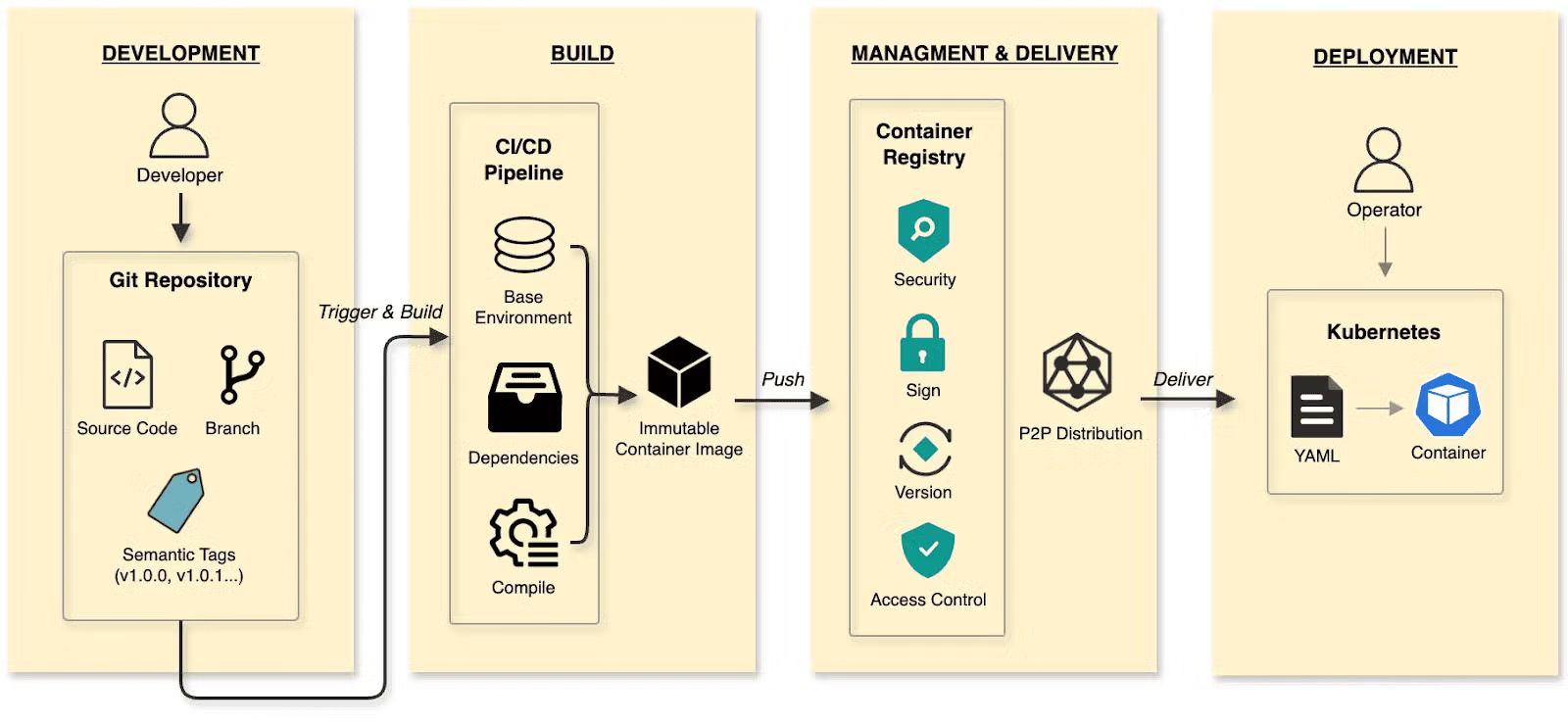

Na era cloud-native, o paradigma de entrega de software amadureceu significativamente.

O fluxo de entrega de software:

- Desenvolvimento: Código commited no Git, versionado via tags.

- Build: Pipelines de CI/CD geram Imagens de Container imutáveis.

- Gerenciamento e Distribuição: Imagens armazenadas em Registries seguros. Segurança na cadeia de suprimentos, RBAC e distribuição P2P garantem a integridade.

- Deployment: DevOps define o estado desejado via YAML, com ciclo de vida gerenciado pelo Kubernetes.

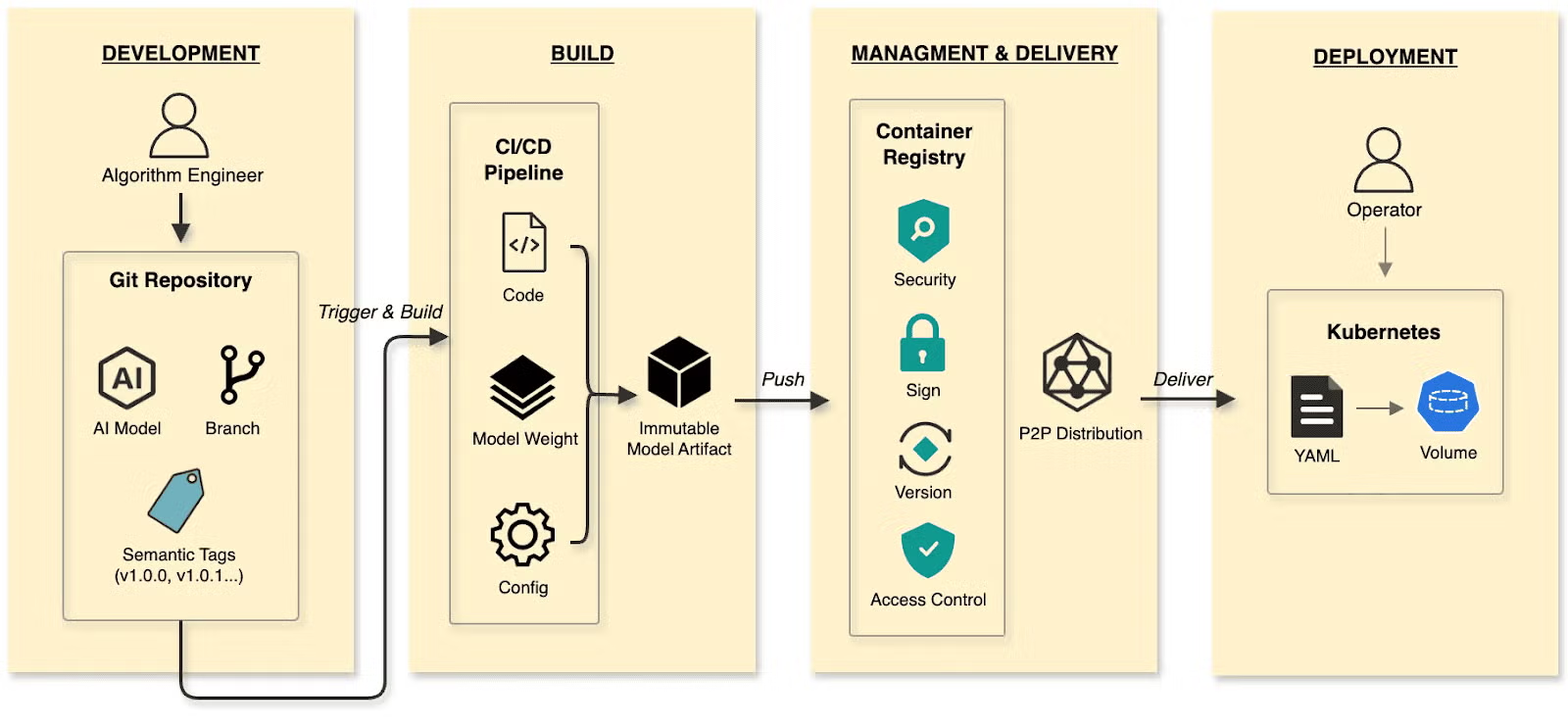

A entrega cloud-native de modelos de IA:

- Desenvolvimento: Engenheiros de IA fazem push de pesos e configs (usando o Hugging Face Hub como repositório de origem).

- Build: Pipelines CI/CD empacotam pesos, configurações de runtime e metadados em um Artefato de Modelo.

- Gerenciamento e Distribuição: Artefatos gerenciados por um Registry, reutilizando todo o toolchain existente.

- Deployment: Engenheiros utilizam OCI Volumes ou Model CSI Drivers, montando modelos em containers de inferência (vLLM, SGLang) de forma desacoplada.

Seguindo o pipeline na prática

O modctl é a ferramenta CLI que padroniza o empacotamento de modelos em artefatos OCI. O fluxo inclui a geração de Modelfile, login em um Registry como o Harbor, build do artefato e push para o repositório.

O papel do Harbor na gestão

O Harbor não é apenas um repositório, é o padrão para gerenciar o ciclo de vida dos modelos:

- Versioning: Tags imutáveis e SHA256 digests garantem ambientes de inferência determinísticos.

- RBAC: Controle fino sobre quem pode realizar PUSH (eng. de dados) ou apenas PULL (serviços de inferência).

- Segurança: Integração com Cosign para assinatura de artefatos e prevenção de model poisoning.

O papel do Dragonfly na distribuição

Para cenários de alto desempenho, o Dragonfly utiliza o paradigma P2P, otimizando a distribuição para centenas de nós simultâneos e evitando congestionamentos na origem. Com recursos como pré-aquecimento, modelos são cacheados localmente nos inferencing nodes antes do escalonamento, reduzindo o tempo de boot de minutos para milissegundos.

O futuro do deploy: OCI Volumes

A partir do Kubernetes 1.33, o suporte nativo a ImageVolumes permite montar camadas de modelos sem a necessidade de drivers externos ou descompressão redundante, elevando a performance operacional a um novo patamar.

Artigo originalmente publicado por Wenbo Qi (Dragonfly/ModelPack Maintainer), Chenyu Zhang (Harbor/ModelPack Maintainer) and Feynman Zhou (ORAS Maintainer and CNCF Ambassador) em Cloud Native Computing Foundation.