A detecção de drift é o pilar fundamental da governança em nuvem, mas, na prática, ela apenas nos alerta que algo saiu do lugar. Saber o que mudou, sem entender o porquê ou o impacto imediato, força times de engenharia a gastar horas em investigações manuais e pouco eficientes. A verdadeira virada de chave para times que buscam eficiência operacional é transformar a detecção em diagnóstico inteligente.

🌍 Um Cenário de Mundo Real

Recentemente, em um deployment de produção de uma plataforma de IA enterprise, a infraestrutura parecia impecável:

- ✅ Deployment via IaC (Terraform);

- ✅ Private endpoints devidamente implementados;

- ✅ Acesso público desabilitado em todos os serviços de IA.

Horas depois, um alerta de segurança disparou: o endpoint do Azure OpenAI estava acessível publicamente. Um pesadelo operacional e de conformidade.

🔍 A Resposta do Time

- Execução de

terraform plan→ ✅ Drift detectado. - Verificação no Azure Portal → ✅ Configuration mismatch confirmado.

- Análise de activity logs → ❓ Múltiplas alterações encontradas, mas sem clareza de quem foi ou a motivação.

🚫 O Problema

Ferramentas de drift detection entregam o “erro”, mas falham em responder às perguntas críticas: Por que mudou? Quem alterou? Foi intencional? Qual o impacto real? Isso tudo gera um gargalo de horas em troubleshooting manual.

💡 A Mudança: Da Detecção ao Diagnóstico

O futuro da gestão de infraestrutura não está apenas em monitorar o state, mas em correlacionar dados de forma inteligente. Precisamos de sistemas que expliquem o drift e sugiram as próximas ações.

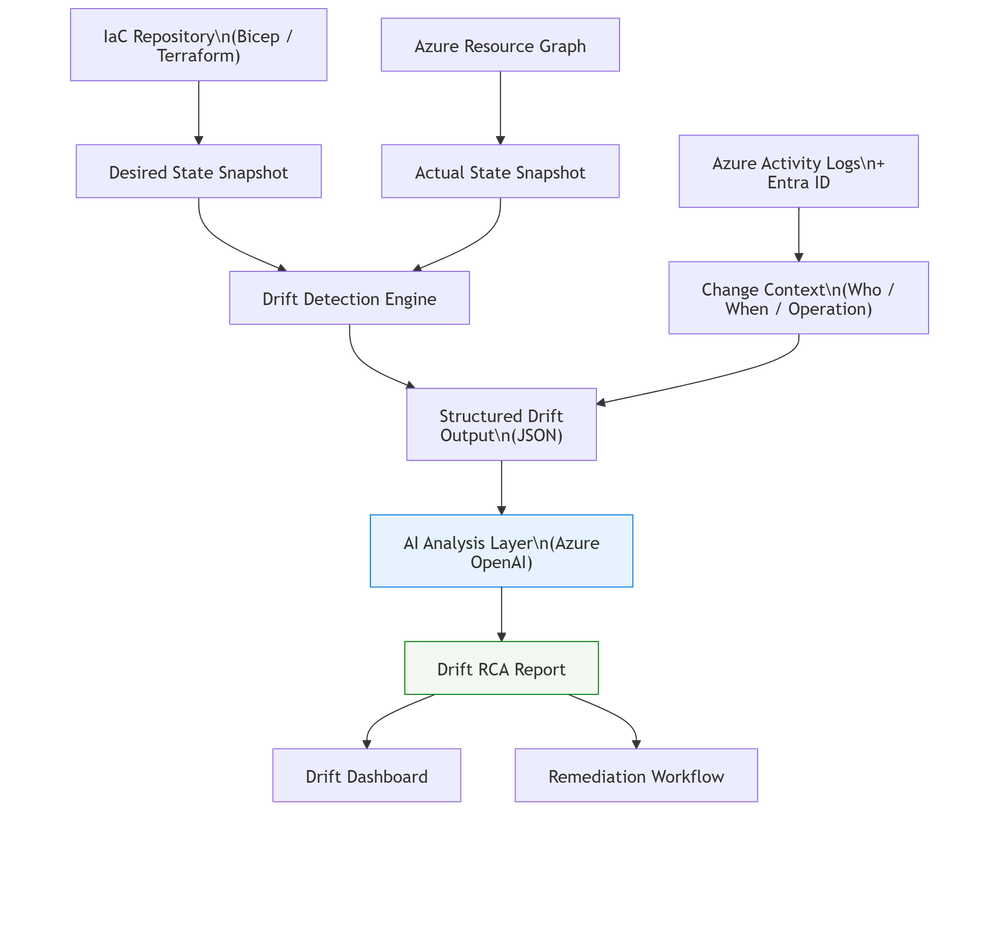

🏗️ Visão de Arquitetura

Abaixo, observamos a estratégia para consolidar dados do Azure e delegar a análise de causa raiz (RCA) para um modelo de IA:

🔧 Como Funciona (Step-by-Step)

✅ Passo 1 — Detectar Drift

Utilize ferramentas de IaC para comparar o desired state com o actual state:

- Terraform:

terraform plan - Bicep:

az deployment group what-if --resource-group rg-ai --template-file main.bicep

✅ Passo 2 — Capturar o Real State

Consulte o Azure Resource Graph para obter os metadados atuais:

Resources

| project id, name, type, location, properties

✅ Passo 3 — Adicionar Contexto (Passo Crítico)

Drift sem contexto é, muitas vezes, inútil. É aqui que entram os Activity Logs:

AzureActivity

| where TimeGenerated > ago(24h)

| project TimeGenerated, ResourceId, OperationName, Caller

Isso cruza quem fez a alteração, qual operação foi executada e o timestamp exato.

✅ Passo 4 — AI-Powered RCA

Em vez de interpretar o JSON manualmente, estruturamos os dados para que a IA gere um relatório de Root Cause Analysis legível e acionável.

Exemplo de Input para a IA:

{

"resource": "openai-endpoint-prod",

"expected": { "publicNetworkAccess": "Disabled" },

"actual": { "publicNetworkAccess": "Enabled" },

"activityLog": { "caller": "[email protected]", "operation": "write", "time": "2026-04-28T10:15:00Z" }

}

Output da IA (Resumo de RCA):

- Drift Summary: O endpoint OpenAI está com acesso público, divergindo do padrão de segurança.

- Root Cause: Alteração manual via Azure Portal realizada pelo usuário [email protected].

- Impacto: Exposição ao tráfego público e violação de security baseline.

- Recommended Action: Reverter via IaC, aplicar Azure Policy de enforcement e restringir via RBAC/PIM.

📊 Visão Operacional: Drift Digest

Ao consolidar, os times podem mover o foco do reativo para o proativo:

| Recurso | Tipo de Drift | Risco | Causa Raiz | Ação |

|---|---|---|---|---|

| OpenAI Endpoint | Network Exposure | 🔴 High | Portal change | Revert + Policy |

| Storage Account | Security Drift | 🔴 High | Script update | Validate automation |

| Key Vault | RBAC Drift | 🔴 Critical | Manual access | Audit roles |

✅ Práticas Recomendadas

- Sintonize as fontes: Sempre combine estado de IaC, Resource Graph e Activity Logs.

- Limite a auto-remediação: Nunca automatize o rollback sem validação humana em ambientes críticos.

- Ferramentas de Prevenção: Utilize Azure Policy para bloquear comportamentos indesejados e PIM (Privileged Identity Management) para restringir permissões de escrita.

- Cultura de Observability: Gere um relatório de drift semanal (o "Drift Digest") para revisar padrões de erro e ajustar processos de CI/CD.

✍️ Conclusão

Em ambientes de alta complexidade, o drift é inevitável. No entanto, com a união de observabilidade, contexto e inteligência artificial, o desvio deixa de ser uma fonte de estresse no incident management e passa a ser uma fonte de dados para o constante fortalecimento da sua infraestrutura.

Artigo originalmente publicado em Azure Updates - Latest from Azure Charts.