A adoção em escala de inteligência artificial generativa trouxe desafios operacionais agudos para empresas brasileiras, especialmente aquelas que transitam entre diferentes provedores (como OpenAI, Google Gemini e modelos em Azure AI Foundry). Sem um plano de controle centralizado, o que se observa é uma fragmentação na governança, inconsistência na experiência do desenvolvedor e, pior, custos de consumo de tokens que saem rapidamente de qualquer controle orçamentário (FinOps).

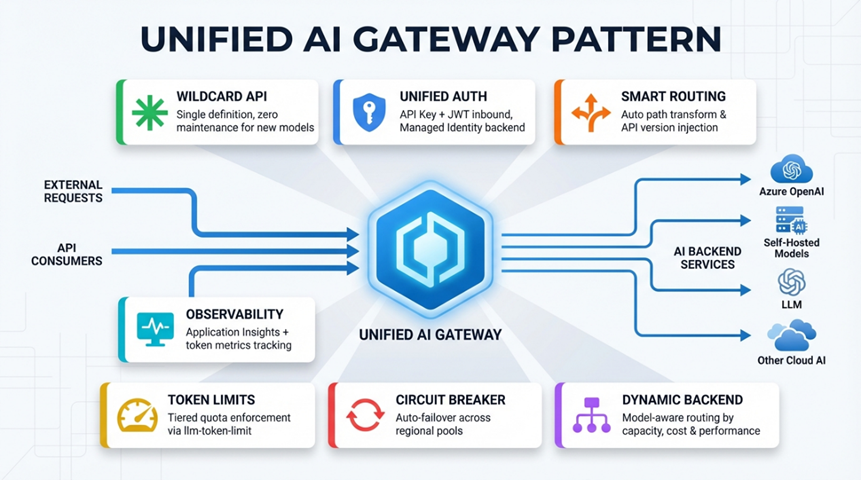

Para resolver isso, uma arquitetura de referência, desenhada pela empresa Uniper, utiliza o Azure API Management não apenas como um gerenciador de APIs tradicional, mas como um Unified AI Gateway. Esse padrão utiliza a extensibilidade de políticas (policy fragments) da plataforma para criar uma camada de intermediação inteligente, capaz de normalizar requisições e aplicar controles centralizados.

Desafios no Escalonamento de Serviços de IA

À medida que o volume de experimentos e aplicações em produção aumenta, a gestão convencional REST/SOAP torna-se insustentável. Para cada novo modelo, provedor ou versão de API, as empresas acabam criando definições de API separadas, o que gera um overhead de gerenciamento proibitivo. Além disso, a falta de inteligência no roteamento impede que a engenharia direcione o tráfego com base em performance, custo ou capacidade de infraestrutura.

A proliferação de schemas para cada variação de provider ou versão do modelo (ex: gpt-4.1-mini vs gpt-4.1) resulta em uma complexidade de manutenção que trava o time de DevOps e impede que novas funcionalidades cheguem ao mercado de forma célere. A necessidade de um Unified AI Gateway surge então como um imperativo de agilidade e estabilidade.

O Pattern de Unified AI Gateway: Componentes Core

O grande trunfo desta abordagem é a utilização de um único endpoint de API com wildcard operations (/*), eliminando a necessidade de atualizar o gateway a cada mudança no back-end. Os componentes fundamentais incluem:

- Roteamento Dinâmico e Load Balancing: Uso de pools para tráfego entre diferentes regiões e modelos, com circuit breakers para garantir a resiliência.

- Normalização de Requisições: Transformação atômica de caminhos de API, garantindo que o front-end e os SDKs dos desenvolvedores sejam mantidos consistentes, independentemente do provedor final.

- Gestão de Custos e Limites (FinOps): Implementação de políticas de

llm-token-limitellm-emit-token-metric, permitindo o monitoramento granular do consumo por centro de custo via Application Insights. - Autenticação Unificada: Centralização da validação de JWT e chaves de API, com a segurança garantida pelo uso de managed identity na comunicação com os back-ends.

Impacto Prático e Resultados nos Negócios

Para organizações globais, a adoção deste padrão resulta em:

- Redução drástica de complexidade: Acompanhando o caso da Uniper, houve uma redução de cerca de 85% no volume de definições de API, consolidando múltiplas fronteiras em um único ponto de entrada.

- Velocidade de Time-to-Market: Com a eliminação de migrações manuais de schema, a disponibilização de novos modelos é quase imediata (reduzindo prazos de meses para dias).

- Observabilidade Total: A capacidade de auditar o que está sendo injetado nos prompts e o quanto de tokens está sendo consumido é fundamental para o compliance (SecOps).

Quando Considerar este Padrão?

A implementação de um AI Gateway centralizado é recomendada para empresas que já estão em um nível de maturidade onde o uso de múltiplas LLMs é uma realidade (ou uma meta). Se o seu cenário exige rotinas flexíveis, roteamento baseado em custo ou um alto grau de governança, este modelo de policy-driven architecture é o caminho a ser trilhado.

Por outro lado, para aplicações simples ou com um único modelo de linguagem em uso, manter o design atual pode ser mais eficiente e menos custoso para a equipe de infraestrutura.

Artigo originalmente publicado em Azure Updates - Latest from Azure Charts.