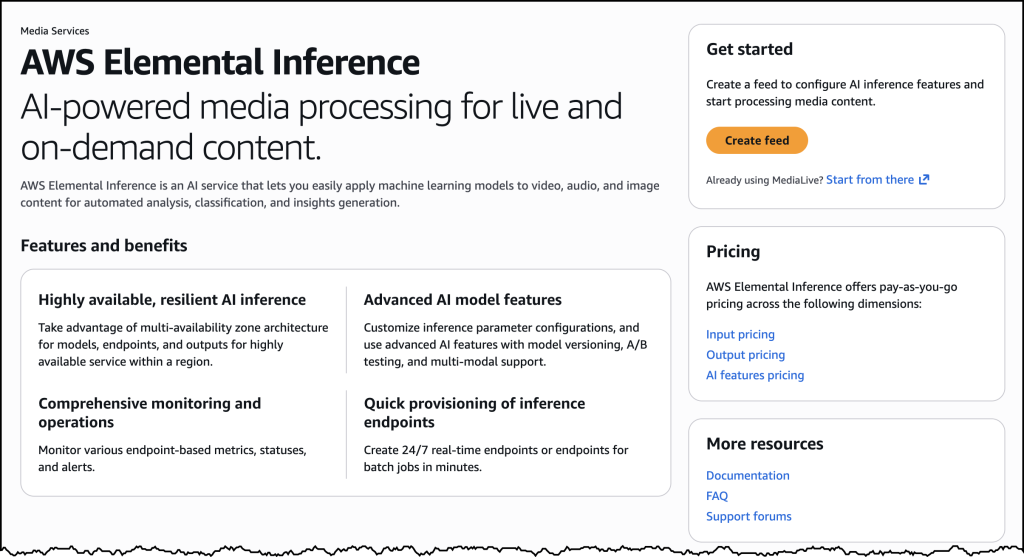

A AWS acaba de anunciar o AWS Elemental Inference, um serviço de IA totalmente gerenciado que transforma e maximiza transmissões de vídeo live e on-demand para engajar audiências em escala. No lançamento, o foco central é a adaptação de conteúdo de vídeo para formatos verticais, otimizados para dispositivos móveis e plataformas sociais em tempo real.

Para empresas de mídia e streamers brasileiros, isso resolve um gargalo operacional crítico: a necessidade de alcançar públicos em plataformas como TikTok, Instagram Reels e YouTube Shorts sem depender de processos manuais exaustivos de post-production ou de uma equipe interna especializada em IA.

O comportamento do consumidor mudou drasticamente. Enquanto a maioria das produções ainda é feita no formato landscape (horizontal), o consumo mobile exige o vertical. Historicamente, essa conversão exigia edição manual, o que fazia com que momentos virais fossem perdidos devido ao delay entre a transmissão original e a postagem adaptada.

Colocando a mão na massa

O AWS Elemental Inference oferece opções flexíveis de deployment para se ajustar ao seu workflow existente. Você pode criar um feed através do console standalone ou configurar o serviço diretamente via console do AWS Elemental MediaLive.

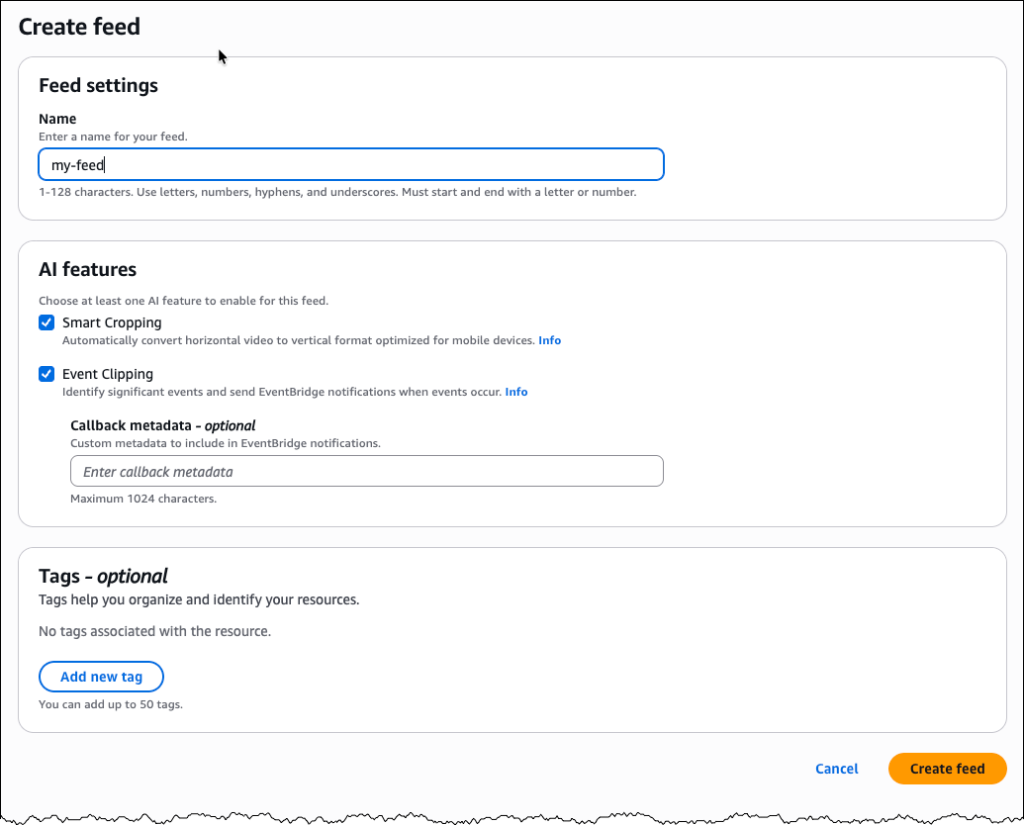

Para começar, navegue até o AWS Management Console e selecione AWS Elemental Inference. No dashboard, escolha Create feed para estabelecer seu recurso principal. Um feed contém suas configurações de funcionalidades e passa pelo estado de CREATING até se tornar AVAILABLE.

Após criar seu feed, você pode configurar outputs para crop (recorte) vertical ou geração de clipes. Para o cropping, o serviço gerencia automaticamente os parâmetros com base nas especificações do vídeo. Para geração de clipes, basta adicionar um output, definir um nome (como "highlight-clips"), selecionar Clipping como tipo de saída e ativar o status para ENABLED.

Essa interface simplifica a gestão das transformações baseadas em IA, tornando direta a criação de conteúdo vertical e a extração de destaques.

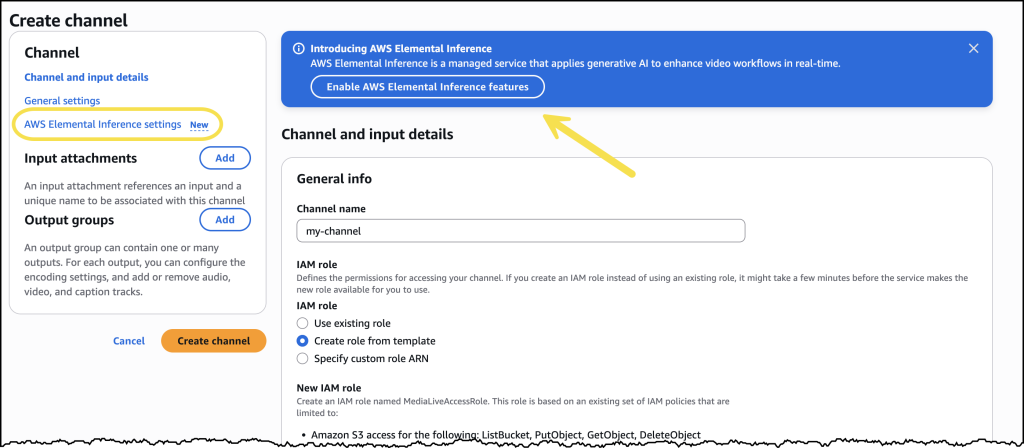

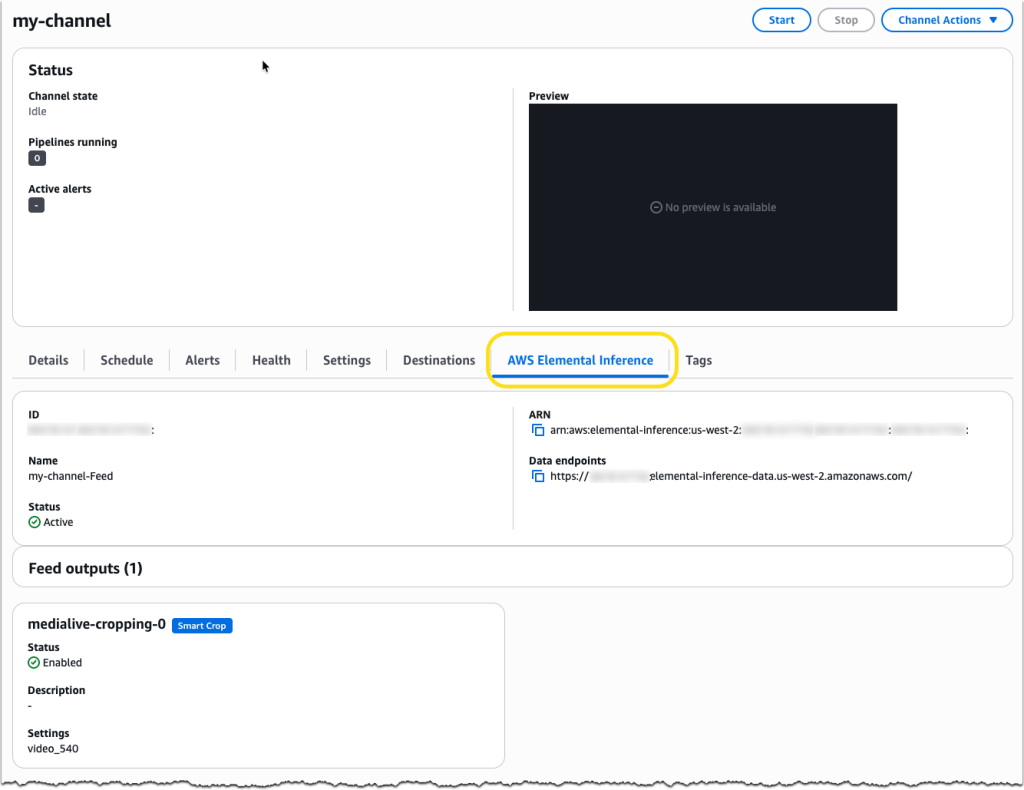

Alternativamente, você pode habilitar o AWS Elemental Inference diretamente nas configurações do seu canal no AWS Elemental MediaLive. Essa abordagem integrada permite adicionar recursos de IA a workflows de vídeo profissionais já existentes sem modificar a arquitetura de rede ou de encodificação. O serviço opera de forma paralela ao processamento de vídeo.

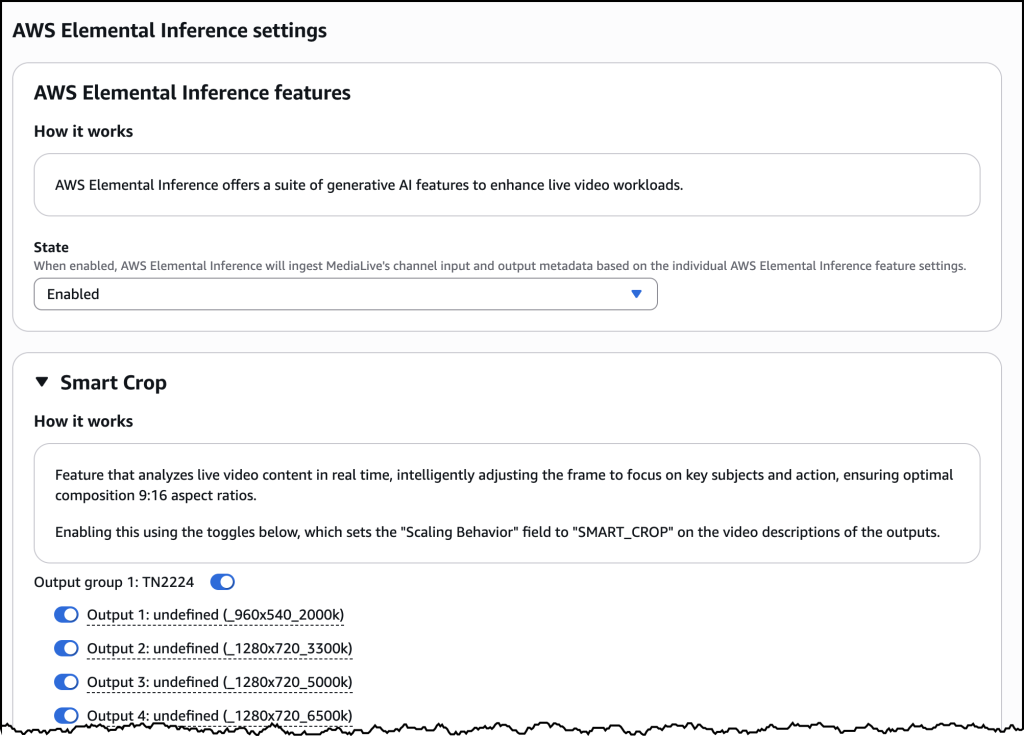

Uma vez habilitado, é possível configurar o Smart Crop com outputs para diferentes resoluções dentro de um Output group.

O MediaLive agora inclui uma aba dedicada ao AWS Elemental Inference na página de detalhes do canal, centralizando a visualização do Amazon Resource Name (ARN), endpoints de dados e detalhes de saída do feed, incluindo o status operacional de funções como o Smart Crop.

Como o AWS Elemental Inference funciona na prática

O serviço utiliza uma aplicação de IA agêntica que analisa o vídeo em tempo real e aplica otimizações nos momentos exatos. A detecção para o crop vertical e a geração de clipes ocorrem de forma independente, executando transformações multi-etapas que não exigem intervenção humana.

O diferencial técnico aqui é a ausência de necessidade de prompts constantes. Enquanto o time foca na produção de alta qualidade, a IA trabalha de forma autônoma para otimizar o conteúdo.

Em termos de performance, a latência observada é de apenas 6 a 10 segundos, um ganho absurdo comparado aos minutos (ou horas) de processos tradicionais de post-processing. O método "process once, optimize everywhere" permite que múltiplos recursos de IA rodem simultaneamente no mesmo stream de vídeo, economizando throughput e custos de processamento.

O uso de Foundation Models (FMs) totalmente gerenciados elimina a barreira técnica de precisar de cientistas de dados especializados para manter os modelos atualizados; a AWS cuida do ciclo de vida da IA.

Principais funcionalidades no lançamento

- Criação de Vídeo Vertical (Smart Crop): Transforma transmissões landscape em formato 9:16. A IA rastreia os sujeitos e mantém a ação principal visível, preservando a qualidade broadcast.

- Geração de Clipes com Metadados Avançados: Detecta e extrai clipes automaticamente de lives. Ideal para esportes (como futebol e basquete), identificando gols ou jogadas decisivas para distribuição imediata, reduzindo o tempo de edição de horas para minutos.

Disponibilidade e FinOps

O AWS Elemental Inference já está disponível nas regiões US East (N. Virginia), US West (Oregon), Europe (Ireland) e Asia Pacific (Mumbai). No Brasil, empresas podem integrar o serviço via console MediaLive ou através de APIs.

Do ponto de vista de FinOps, o modelo de precificação é baseado em consumo: você paga apenas pelo que processa, sem custos de setup ou compromissos de longo prazo. Isso permite escalar agressivamente em grandes eventos sazonais e reduzir custos significativamente em períodos de baixa demanda.

Artigo originalmente publicado por Micah Walter em AWS News Blog.