O mercado de cloud acaba de ganhar um novo referencial de potência para processamento de alto desempenho. O Google Cloud anunciou a General Availability (GA) das H4D VMs, a mais recente família de instâncias otimizadas para High Performance Computing (HPC). Equipadas com a 5ª Geração de processadores AMD EPYC™, essas máquinas não apenas aumentam o throughput bruto, mas atacam gargalos históricos de latência e escalabilidade em ambientes distribuídos.

Para empresas brasileiras de setores como manufatura, saúde, previsão meteorológica e EDA (Electronic Design Automation), a chegada das H4D representa uma mudança estratégica na forma de consumir infraestrutura. A integração nativa com o Cluster Toolkit (via Slurm) e Google Kubernetes Engine (GKE) permite que times de engenharia escalem clusters complexos quase instantaneamente, reduzindo o time-to-market de simulações críticas.

Um dos grandes diferenciais técnicos deste lançamento é a introdução do Cloud Remote Direct Memory Access (RDMA) no portfólio de CPUs do Google Cloud. Operando sobre o Titanium network adapter, o RDMA permite que a performance de um único nó H4D seja estendida para múltiplos nós com latência mínima, resolvendo o problema de comunicação entre instâncias que frequentemente limita a escalabilidade de workloads de produção em larga escala.

Resultados práticos: Aceleração em diversos domínios

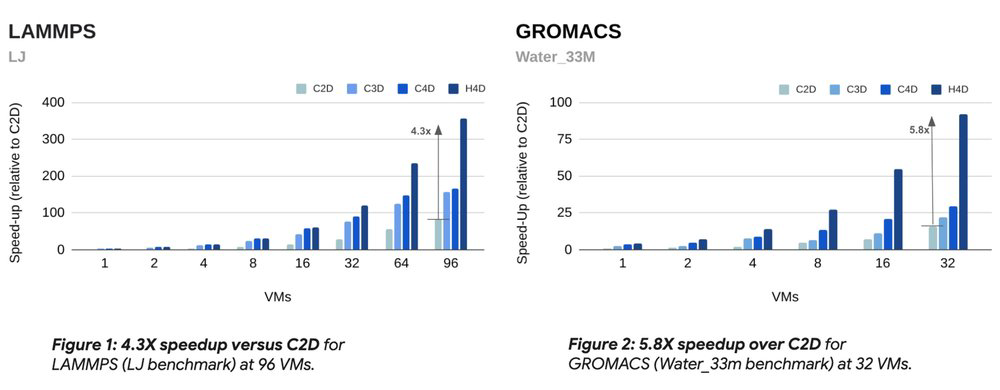

A performance das H4D VMs foi validada através de benchmarks industriais, demonstrando ganhos significativos em relação às gerações anteriores (como a C2D).

Saúde e Life Sciences

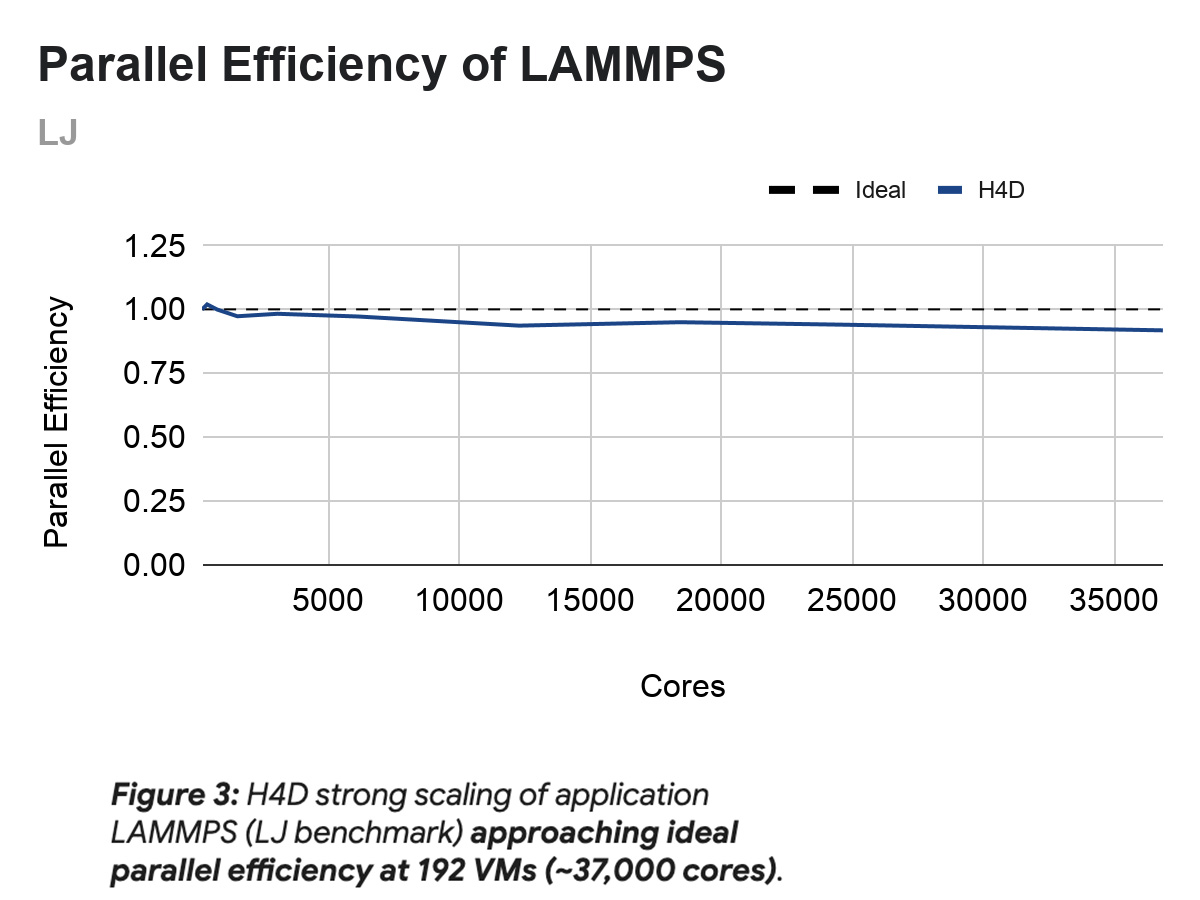

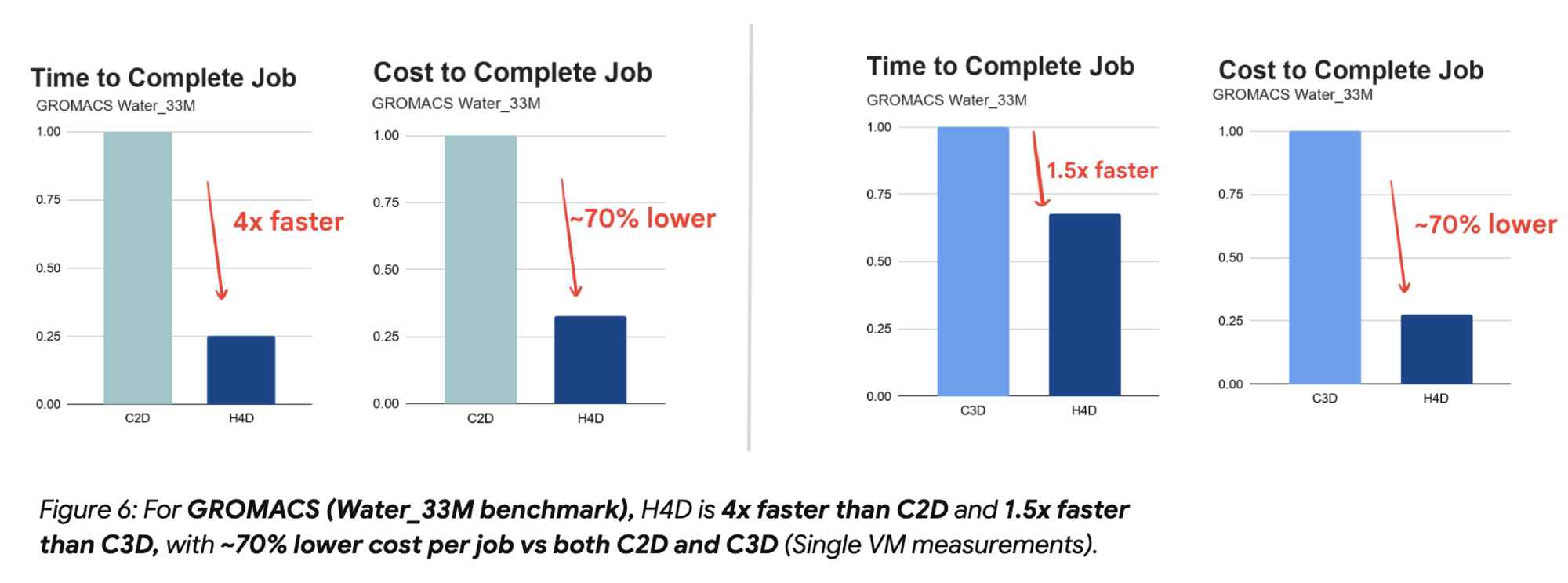

Em simulações moleculares complexas, fundamentais para a descoberta de fármacos, o salto é notável. Comparada à C2D, a H4D entregou um speed-up de até 4.3x rodando LAMMPs (benchmark LJ) com 96 VMs, mantendo uma eficiência paralela de 95% em 18 mil cores. No GROMACS, o ganho chegou a 5.8x em 32 VMs.

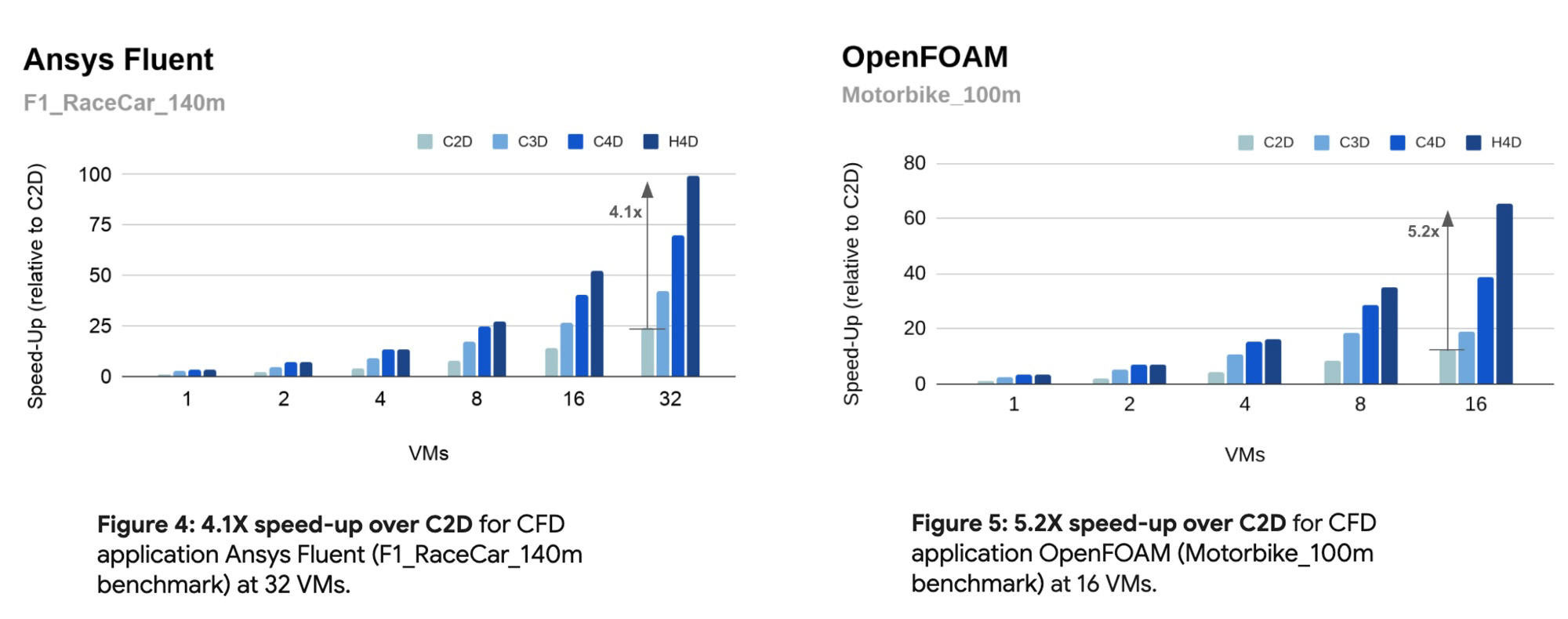

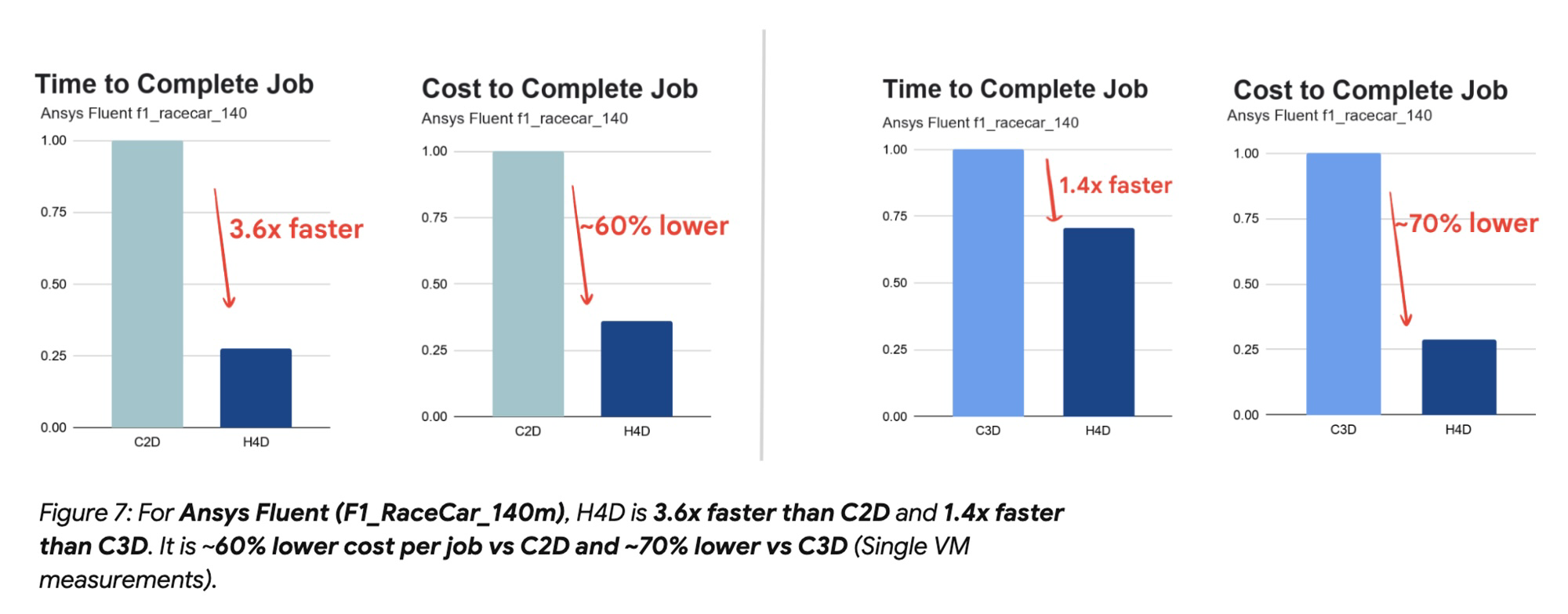

Manufatura e Engenharia (CAE)

Para fluxos de Computer-Aided Engineering, como simulações de dinâmica de fluidos (CFD), a H4D permite ciclos de design muito mais curtos. Em testes com Ansys Fluent, a instância entregou 4.1x mais performance. No caso do OpenFOAM (open-source), o speed-up foi de 5.2x, alcançando uma eficiência paralela superlinear de 122%, o que indica um aproveitamento excepcional do cache e subsistema de memória.

Eficiência Operacional e FinOps: O novo padrão de custo-benefício

Além da performance bruta, a H4D foi desenhada com foco em eficiência financeira. A compatibilidade com o Dynamic Workload Scheduler (DWS) é um ponto-chave para estratégias de FinOps. Com o modo Flex Start, empresas podem acessar capacidade just-in-time, enquanto o modo Calendar garante reservas programadas.

Na prática, isso permite acessar poder computacional HPC por valores tão competitivos quanto 3 centavos de dólar por core-hora, sem a necessidade de contratos de longo prazo (Commitments). Para o gestor de TI no Brasil, isso significa transformar CAPEX em um OPEX extremamente granulado e previsível.

Ecossistema de Gestão e Operação

Implementar clusters densos de H4D é simplificado pelo uso do Cluster Director (agora com recursos avançados de manutenção) e do Cluster Toolkit, que utiliza blueprints prontos para deployment rápido. Para a camada de orquestração de jobs, a integração nativa com o Batch (serviço serverless para filas e provisionamento) retira a carga operacional dos times de infraestrutura, permitindo foco total na análise dos dados.

O que dizem os especialistas do setor

“Testamos a plataforma H4D no early access e os resultados foram impressionantes. Vimos uma melhoria de até 50% no custo-benefício em relação às gerações anteriores, com a estabilidade exigida para nossas operações de alto volume.” — Alex Davies, CTO na Jump Trading

“Existe um mito de que o desempenho máximo só é possível on-premises ou em bare metal devido ao 'imposto do hypervisor'. Nosso benchmark de risco financeiro mostra o contrário: a H4D performa melhor que o topo de linha bare metal da mesma geração da AMD.” — Hamza Mian, CEO na HMxLabs

“A eficiência do fabric RDMA é não-negociável para simulações de crash test e CFD. A H4D provou ser um acelerador real para workloads de engenharia de alto throughput.” — Rodney Mach, Presidente na TotalCAE

“Vimos uma melhoria de 30% em benchmarks de EDA. Isso se traduz diretamente em ciclos de desenvolvimento mais rápidos para nossos times de design de chips.” — Trevor Switkowski, Tech Lead na Google Cloud

Como começar

As instâncias H4D já estão disponíveis em regiões como us-central1 (Iowa), europe-west4 (Holanda) e asia-southeast1 (Singapura), com planos de expansão para outras zonas em breve. Para empresas no Brasil, utilizar essas regiões globais via Cloud RDMA é o caminho mais curto para reduzir latência em processamentos paralelos massivos.

Artigo originalmente publicado por Felix Schürmann em Cloud Blog.