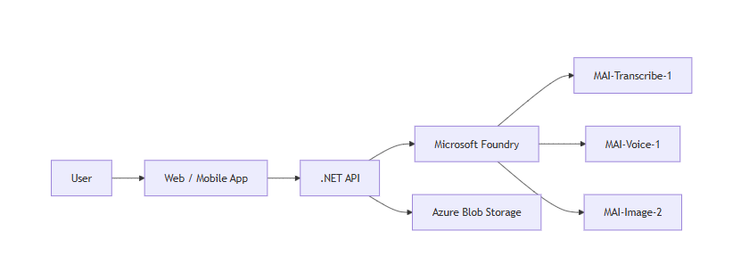

A Microsoft expandiu recentemente seu ecossistema de inteligência artificial com o lançamento da família MAI (Microsoft AI), que introduz modelos latentes em infraestrutura proprietária: MAI-Transcribe-1, MAI-Voice-1 e MAI-Image-2. Diferente da adoção de modelos via parceiros, esta movimentação indica um esforço deliberado da Microsoft para verticalizar sua oferta de AI as a Service, ganhando controle total sobre a performance, governança e custos.

Entendendo os novos modelos

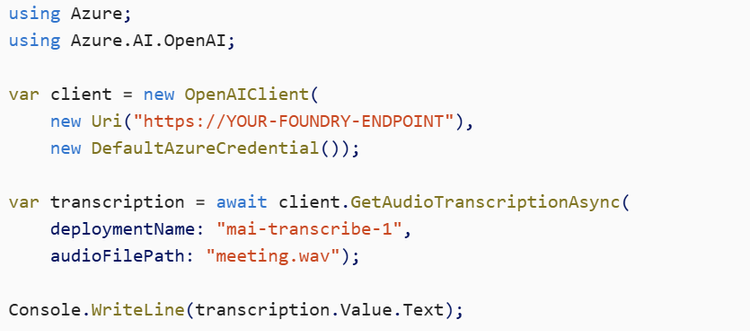

- MAI-Transcribe-1 (Speech-to-Text): Focado em cenários de alta densidade como contact centers e reuniões corporativas. O diferencial aqui é a promessa de redução de custos de GPU, otimizando o processamento de áudios ruidosos em 25 idiomas.

- MAI-Voice-1 (Text-to-Speech): Focado em fidelidade e expressividade. Com geração de 60 segundos por segundo, o modelo visa agentes conversacionais que precisam manter a consistência da identidade do speaker em long-form.

- MAI-Image-2 (Text-to-Image): Já em produção no ecossistema Copilot, este modelo entrega alta fidelidade fotorrealista com capacidade superior de renderização de textos dentro de imagens, um desafio comum para modelos generativos atuais.

Por que isso altera a estratégia de engenharia na Azure?

Para times de engenharia e gestão, a mudança de paradigma vai além de endpoints de API. A transição para uma stack de primeira linha impõe três pilares para sua arquitetura:

- Soberania e First-party Stack: A redução da dependência de provedores externos simplifica a cadeia de suprimentos de IA e os contratos de serviço.

- Enterprise-ready by Default: Diferente de integrações via S3 ou APIs de terceiros, os modelos MAI herdam nativamente o Azure RBAC, Managed Identity e as políticas de Purview. Isso é um divisor de águas para times de SecOps que buscam conformidade rigorosa sem overhead de configuração.

- Agent-first: Os modelos foram desenhados para persistência. Enquanto APIs tradicionais operam em fluxos de requisição-resposta, a arquitetura MAI favorece fluxos de trabalho long-running, essenciais para a implementação de agentes de IA complexos.

Exemplo de integração com MAI-Transcribe-1:

Otimização e Sustentabilidade Operacional

Do ponto de vista de FinOps e eficiência operacional, estas mudanças simplificam drasticamente o observability. Com uma stack única via Microsoft Foundry, temos um single surface de SDKs e quotas, eliminando a fragmentação de modelos que frequentemente infla custos de ineficiência e dificulta o troubleshooting em pipelines:

| Aspecto | Antes dos modelos MAI | Depois com modelos MAI |

|---|---|---|

| Model Ownership | Dependência de terceiros (OpenAI, outros) | Primeira classe Microsoft |

| Enterprise Integration | Integrado via Azure | Nativo a Microsoft Foundry |

| Governance & Compliance | Controles mistos/complexos | RBAC, Entra ID, Purview unificados |

| Agent Readiness | Requisição/Resposta única | Fluxos long-running nativos |

| Custo | Híbrido/Baseado em tokens | Otimizado para performance empresarial |

| Consistência | SDKs e APIs fragmentados | Tooling unificado |

Para empresas brasileiras, em especial as que operam em setores altamente regulados pelos SLAs e exigências de soberania de dados, a adoção destas ferramentas nativas deve ser analisada como uma oportunidade de reduzir o risco operacional, ao mesmo tempo em que se moderniza a stack de IA sem comprometer o governance.

Artigo originalmente publicado em Azure Updates - Latest from Azure Charts.