A arquitetura multi-cloud tornou-se uma realidade incontornável para grandes empresas operando no Brasil, mas essa flexibilidade traz consigo um desafio financeiro e operacional crítico: o custo de movimentação e duplicação de dados. Frequentemente, times de engenharia recorrem a pipelines pesados de ETL (Extract, Transform and Load) para sincronizar datasets entre provedores como Azure, AWS e GCP, resultando em latência, overhead de governança e, principalmente, contas elevadas com taxas de data egress.

O Databricks Delta Sharing surge como um protocolo open-source que altera esse paradigma. Em vez de mover o dado fisicamente, ele foca em habilitar o acesso "in-place" utilizando o Delta Lake como fonte única de verdade. Para gestores de infraestrutura e arquitetos, isso representa uma mudança de mentalidade: trocar a replicação pela conectividade segura.

O que é o Delta Sharing?

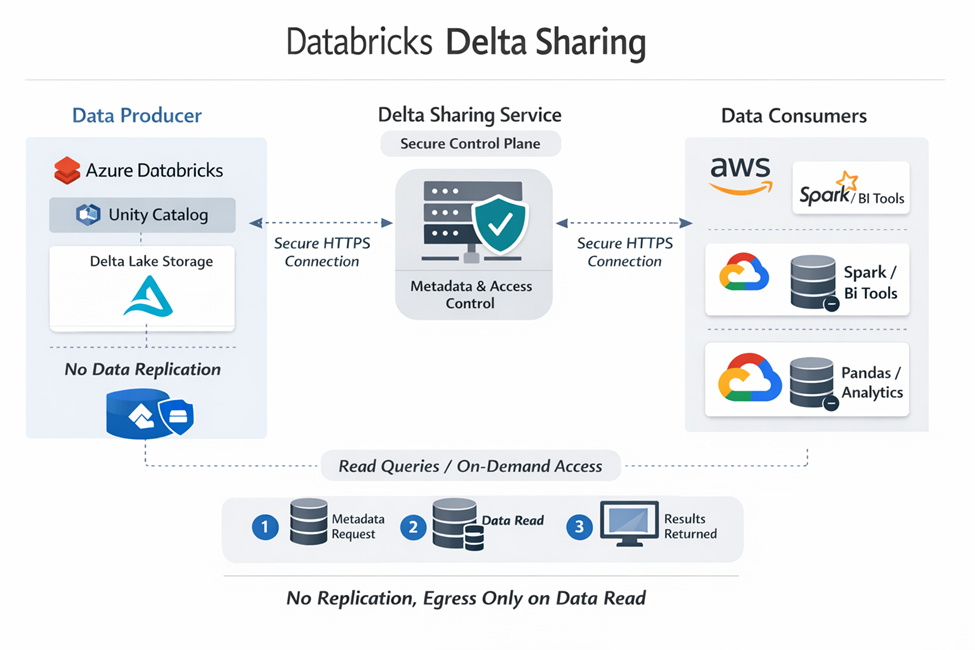

O Delta Sharing funciona como uma camada de abstração que permite compartilhar datasets (tabelas Delta) com consumidores externos, garantindo que eles acessem a versão mais atual dos dados sem que o provedor precise copiar ou sincronizar arquivos extras. Ele atua sobre o armazenamento original, expondo os dados através de um control plane que gerencia autenticação, controle de acesso e auditoria, sem exigir que o consumidor esteja rodando o ecossistema Databricks.

Impactos em Arquiteturas Multi-Cloud

A adoção dessa abordagem traz benefícios tangíveis para times de DevOps e engenharia de dados:

- Fim dos Pipelines de Cópia: Ao eliminar a necessidade de criar pipelines para sincronização contínua, reduzimos a fragilidade operacional (rollback mais fácil) e o tempo de deployment de novos produtos de dados.

- Eficiência de Custos (FinOps): Como o dado não é replicado por default, você evita custos extras de storage. O custo de cloud egress — frequentemente um grande vilão em times com cultura FinOps — é minimizado, sendo gerado apenas sob demanda, quando uma query cruza as fronteiras dos provedores.

- Governança Centralizada: Utilizando o Unity Catalog, é possível aplicar fine-grained permissions e manter o compliance de auditoria unificado, mesmo em um ecossistema complexo e distribuído.

Delta Sharing vs. Replicação: Uma Nova Perspectiva de Design

A ideia de que precisamos replicar dados para realizar analytics entre clouds é um erro comum de projeto. Com o Delta Sharing, o deep clone (replicação total) passa a ser uma escolha arquitetural consciente, reservada para cenários de baixíssima latência ou isolamento extremo, e não um padrão de default.

Considerações Técnicas para Engenharia

- Data Producer: O ambiente (ex: Azure Databricks + Unity Catalog) permanece como a fonte. O controle sobre as tabelas e as operações (read-only) é total.

- Control Plane: O serviço de Delta Sharing gerencia os metadados (esquemas e versões) e garante que apenas consumidores autorizados acessem os endpoints.

- Segurança e Networking: A conexão ocorre via endpoints seguros (HTTPS), permitindo implementações com VPN ou private endpoints, mantendo as políticas de rede sob estrito controle.

- Consumidores Heterogêneos: A neutralidade de interface permite que clusters Spark, bibliotecas como Pandas ou ferramentas de BI consumam os dados diretamente da fonte, sem latência excessiva.

Conclusão: Eficiência com Segurança

Para empresas brasileiras, que buscam escalabilidade sem sacrificar o controle financeiro, o Delta Sharing é uma ferramenta poderosa para simplificar ecossistemas de dados. Ao remover a replicação como requisito obrigatório, reduzimos a complexidade técnica e focamos o budget de TI onde ele realmente gera valor: na entrega de insights e estabilidade para o negócio.

Artigo originalmente publicado em Azure Updates - Latest from Azure Charts.