A era da Inteligência Artificial está forçando as empresas a repensarem sua infraestrutura. O acesso a milhares de GPUs é uma realidade, mas a verdadeira complexidade reside em unir esses recursos em um sistema coerente, eficiente e escalável. Quando o gargalo de sincronização ocorre, pipelines de dados param, a rede sofre latência e o investimento em computação de alto desempenho (HPC) torna-se custo ocioso.

Este desafio não é novo. Há mais de um século, engenheiros enfrentaram um dilema de movimentação massiva através de um sistema restrito: o Canal do Panamá. O sucesso daquela obra não veio apenas do tamanho, mas da orquestração sistêmica. Traçamos um paralelo com o deploy de GPUs AMD no Oracle Cloud Infrastructure (OCI).

Locks → controle de engenharia

O Canal do Panamá utiliza eclusas (locks) para mover navios de forma repetível. Clusters de GPU modernos funcionam sob a mesma lógica: workloads de IA distribuída dependem de milhares de núcleos trabalhando em sincronia, trocando gradientes através de stacks como AMD ROCm e redes RDMA de alta performance.

Quando a infraestrutura carece de controle, pequenas variações de timing geram perda de performance e o temido efeito 'straggler', onde instâncias completas param à espera de nós lentos. A arquitetura bare-metal do OCI aliada ao RDMA de baixo jitter (baixa variação de latência) permite que o sistema comporte-se como uma rede de eclusas: previsível e estável.

Gatun Lake → o fluxo de dados sustentado

O volume de água do Lago Gatun é o que mantém o canal operante. Em sistemas de IA, esse "fluxo" é a ingestão de dados. No OCI, tratamos isso através de uma arquitetura em camadas:

- Object Storage: A fonte durável.

- OCI Managed Lustre Service: A camada de alta vazão (throughput) compartilhada.

- Local NVMe: O working set de alta velocidade.

O uso do Lustre é o diferencial aqui: ele garante que as GPUs não fiquem famintas. Em escala, a perda de processamento não ocorre pela falta de poder bruto, mas pela velocidade de entrega dos dados. Uma GPU ociosa é capital desperdiçado.

Culebra Cut → o gargalo que define a escala

O Culebra Cut era o ponto mais perigoso do canal devido ao risco de congestionamento. Em clusters, milhares de GPUs trocando tráfego simultâneo geram rajadas intensas. Tecnologias como RoCEv2 (RDMA over Converged Ethernet) são essenciais aqui, operando com:

- PFC (Priority Flow Control): Atua como um freio de emergência.

- ECN (Explicit Congestion Notification): Sinaliza congestionamento antes que o buffer transborde.

- DCQCN: Coordenador de controle de taxa fim-a-fim.

A lição para o tomador de decisão é clara: sistemas de IA não escalam com largura de banda de pico; eles escalam com previsibilidade de tráfego sob gargalos.

Controle de pragas → inteligência operacional

O projeto do canal quase fracassou por problemas invisíveis de saúde, difíceis de diagnosticar individualmente. Em cenários de milhares de GPUs, o monitoramento tradicional falha ao não detectar anomalias como thermal throttling ou erros de ECC (Error Correction Code) mascarados.

O OCI oferece um stack de monitoramento integrado que permite aos times de engenharia sair do "modo reativo" para o "controle proativo". A visibilidade de nível de nó e a correlação de telemetria são indispensáveis para garantir que a infraestrutura entregue o ROI esperado.

Escolha e expansão → design para eficiência

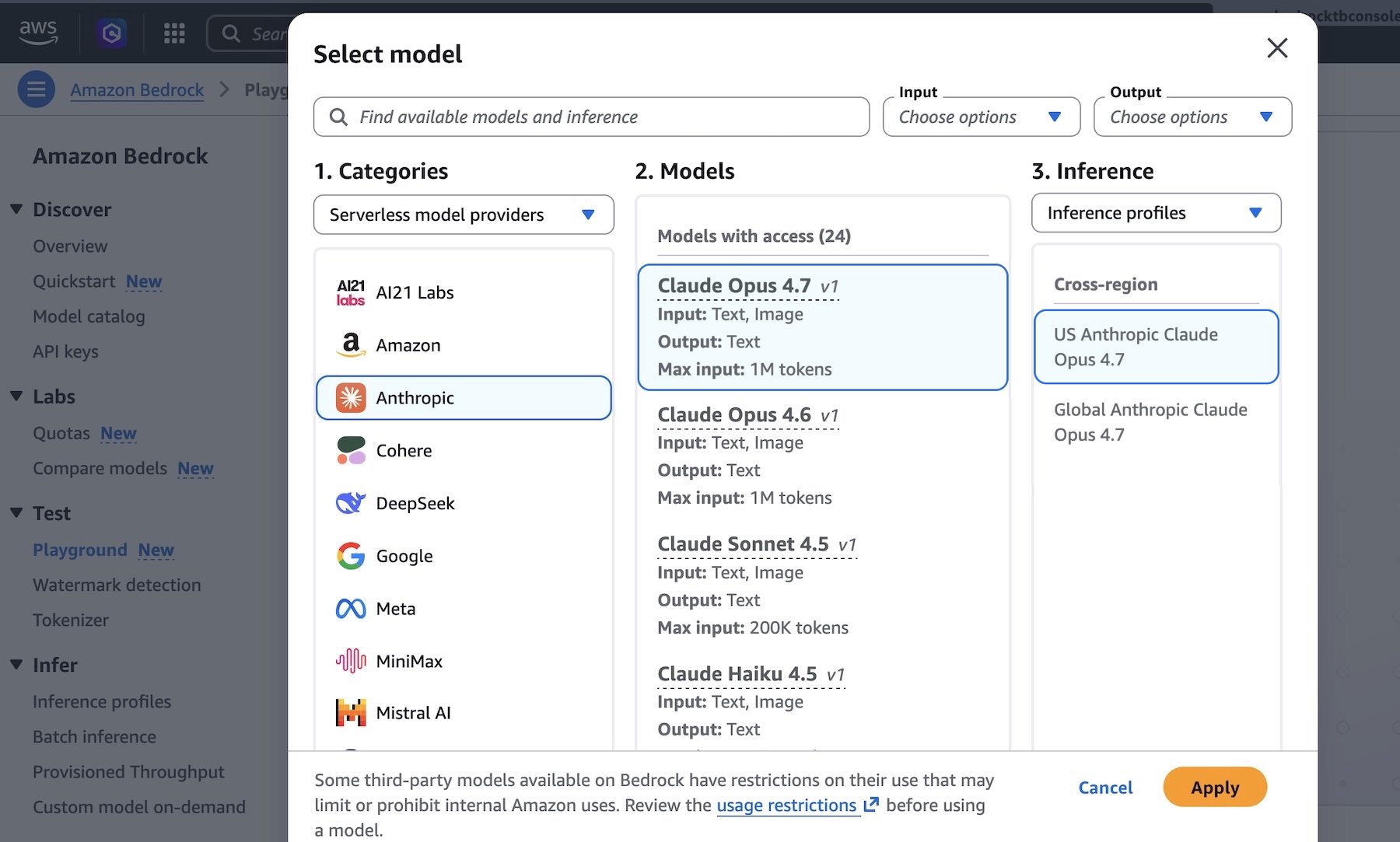

Performance é uma decisão de negócio. Ao escolher shapes de GPU (como as instâncias com MI300X ou MI355X), a capacidade de memória HBM e a largura de banda impactam diretamente no número de pontos de sincronização e na densidade da carga de trabalho. Para empresas brasileiras considerando investimentos em IaaS, o foco deve ser o 'custo por workload completo' e não apenas o preço da hora de computação.

O caminho para o sucesso em IA não está na força bruta do hardware isolado, mas na coordenação e no fluxo de todo o ecossistema. Assim como o Canal do Panamá, o sucesso depende de entender que o sistema é um organismo vivo, que exige medições constantes e ajustes finos.

Artigo originalmente publicado por (autor não identificado) em cloud-infrastructure.